Futuro Digital

|

jueves, diciembre 13, 2012

|

Todas nuestras tecnologías inalámbricas, sin excepción, desde las que permiten que hablemos por celulares o nos conectemos al Internet por WiFi, y desde las ondas que penetran nuestro cuerpos, hasta los auriculares Bluetooth que se utilizan en los celulares de hoy día, utilizan de alguna forma u otra distintos tipos de ondas electromagnéticas. Todas nuestras tecnologías inalámbricas, sin excepción, desde las que permiten que hablemos por celulares o nos conectemos al Internet por WiFi, y desde las ondas que penetran nuestro cuerpos, hasta los auriculares Bluetooth que se utilizan en los celulares de hoy día, utilizan de alguna forma u otra distintos tipos de ondas electromagnéticas.Esas ondas, obviamente, son invisibles a ojos humanos, pero son una de las cosas más importantes de nuestra ciencia y tecnología. Estas ondas vienen en distintos "tamaños", desde "ondas cortas" hasta "ondas largas", y una forma de imaginarlo es una cuerda que hacemos ondular, en donde si hacemos que esta ondule con curvas pequeñas podríamos decir que son ondas cortas, y si hablamos de ondulaciones largas, pues ondas largas... Sin embargo, un tipo de ondas han sido notoriamente difíciles de domar, las llamadas ondas "TeraHertz", que son ondas ultra-cortas que vibran billones de ciclos por segundo, y si podemos domar ese tipo de ondas, toda una nueva generación de nuevas tecnologías serán posibles, y eso precisamente es lo que han logrado un grupo de investigadores del California Institute of Technology (CalTech). Estas ondas ya teníamos tiempos que las generábamos, pero con equipos bastante grandes, pesados y costosos, y lo que este equipo de CalTech ha logrado es miniaturizar la tecnología al tamaño de un microchip varias veces más pequeño que la uña de tu dedo meñique. Esto abre entonces la puerta a toda una nueva generación de posibles aplicaciones que van desde mejores equipos para ver mejor dentro del cuerpo humano en 3D y a muy bajo costo, hasta dispositivos del tamaño de celulares que nos permitirán ver cosas tras paredes de concreto armado. Así mismo esto haría posible nuevos equipos de revisión de seguridad en aeropuertos que nos harían el pasar por tales lugares una experiencia más placentera, así como podría significa el nacimiento de nuevas tecnologías para nosotros interactuar con dispositivos electrónicos por medio de gestos, e incluso quizás nuevas formas de comunicarnos en forma ultra-rápida y con gran ancho de banda en dispositivos móviles. Y esto, a propósito, es uno de los componentes claves del Sensorix. Nota: En la imagen que acompaña el artículo, lo microchips son los 4 pequeños cuadritos marrones entre el logo de CalTech y la moneda de un centavo de los EEUU. fuente autor: josé elías |

|

|

|

|

|

martes, diciembre 11, 2012

|

Por años hemos hablado y leído sobre tecnología de chips fotónicos (que funcionan a base de luz) de distintas empresas y laboratorios universitarios, pero al final de cuentas acaba de ser IBM la primera en anunciar que ha perfeccionado una técnica de fabricación que los hace hoy día una realidad comercial. Por años hemos hablado y leído sobre tecnología de chips fotónicos (que funcionan a base de luz) de distintas empresas y laboratorios universitarios, pero al final de cuentas acaba de ser IBM la primera en anunciar que ha perfeccionado una técnica de fabricación que los hace hoy día una realidad comercial.La empresa ha anunciado la primera generación de chips ópticos fabricados con técnicas tridimensionales de 90nn que permite fabricar en el mismo chip el equivalente a rayos lásers en miniatura, que pueden ser utilizados como puntos de redes en telecomunicaciones tanto remotas (como en Internet) como locales (sea una red local, o dentro de una misma PC). Para que tengan una idea de lo que hablamos, IBM dice poder agregar "grandes cantidades" de circuitos que transmiten datos a 25Gbps, para entre todos formar canales virtuales de comunicación de "varios TeraBytes por segundo". Para que tengan una idea, un película típica de Blu-ray ocupa unos 25GB de espacio, por lo que con esta tecnología hablamos de poner transmitir unos 40 discos de películas Blu-ray, en un solo segundo. Otra forma de verlo es que podemos transmitir unos 12,000 discos compactos de música (de unos 700Mb cada uno), por segundo. Pero quizás lo mejor de todo esto, es que debido a que esto es un proceso relativamente barato de producir, y extremadamente miniaturizado, que hablamos de reducir sustancialmente el costo de infraestructura de redes y comunicación inter-chips, lo que permitirá que las velocidades de Internet continúen creciendo a niveles exponenciales en los próximos años. Este es precisamente el tipo de tecnología que permitirá que en unos años cualquier persona tenga acceso a velocidades de Internet de 1Gbps en su hogar... nota de prensa oficial de IBM autor: josé elías |

|

|

|

|

|

|

Investigadores del Centre for Microsystems Technology acaban de acercarnos un paso más a un futuro en donde todos poseeremos lentes de contacto biónicos que desplegarán información directamente a la retina de nuestros ojos, en esencia creando tanto una Realidad Virtual como una Realidad Aumentada en cualquier momento que lo deseemos. Investigadores del Centre for Microsystems Technology acaban de acercarnos un paso más a un futuro en donde todos poseeremos lentes de contacto biónicos que desplegarán información directamente a la retina de nuestros ojos, en esencia creando tanto una Realidad Virtual como una Realidad Aumentada en cualquier momento que lo deseemos.A la fecha, los avances realizados han sido prototipos de tamaño bastante grandes, pero este es el primer prototipo experimental en donde el lente de contacto y la pantalla han sido creados en tamaño real. Por el momento, el prototipo tiene un patrón de pixeles pre-configurados con la imagen de un símbolo de dólar (¿quizás un mensaje subliminar a inversionistas de que hay mucho dinero por hacer en este espacio?), pero obviamente la idea es construir futuros prototipos con gráficos dinámicos que desplieguen cualquier imagen y a todo color. Paralelo a esto, la investigación además se está centrando en técnicas que nos permitirán enfocar la luz del lente de contacto de biónico de forma tal que la imagen que percibamos se fusionará (y enfocará) junto con las imágenes reales del mundo exterior, similar a esto. fuente fuente secundaria imagen de alta resolución del prototipo Video a continuación (enlace YouTube)... autor: josé elías |

|

|

|

|

|

martes, diciembre 4, 2012

|

Acabamos de dar un paso más hacia un futuro que muchos hubiesen pensado tomaría décadas o incluso siglos: La reconocida cadena de tiendas Staples, especializada en ofrecer insumos para oficinas (desde papel hasta grapadoras, y desde sillas hasta tabletas) recientemente anunció que se convertirá en la primera empresa del mundo en ofrecer servicios de impresión en 3D a escala masiva en consumidores. Acabamos de dar un paso más hacia un futuro que muchos hubiesen pensado tomaría décadas o incluso siglos: La reconocida cadena de tiendas Staples, especializada en ofrecer insumos para oficinas (desde papel hasta grapadoras, y desde sillas hasta tabletas) recientemente anunció que se convertirá en la primera empresa del mundo en ofrecer servicios de impresión en 3D a escala masiva en consumidores.Es decir, hablamos de imprimir objetos tridimensionales, como por ejemplo, una maqueta de un edificio por parte de un arquitecto, o quizás una réplica 3D de las cabezas de tu familia, o posiblemente un bosquejo en 3D del prototipo del nuevo control de video-juegos que estás ideando para revolucionar la industria... Las impresiones inicialmente serán basadas en una técnica que utiliza papel (desarrollada por la empresa MCOR y su proceso IRIS), para entre varias capas "extraer" un objeto sólido tridimensional, el cual puedes manipular como cualquier otro objeto en tus manos. Ojo, esta no es una impresora a nivel atómico capaz de imprimir cualquier cosa, pero el solo hecho de que por fin esta tecnología se va a masificar, es motivo de celebración, pues significa que esta tecnología entrará en una etapa de aceleración exponencial como toda otra tecnología que entra en una etapa similar. En cuanto al servicio, este estará disponible inicialmente en Bélgica y Holanda en el 2013 (pero eventualmente se espera que esté disponible en todo país en donde Staples opere), y de la manera que funciona es que el usuario sube a la página web de Staples la descripción del objeto a imprimir en uno de los formatos de "3D sólido" que soportará Staples, y después sencillamente elige en cual Staples recogerlo, o incluso tendrá opción de que le envíen el objeto a su domicilio. Yo ya me imagino unas cuantas empresas surgiendo que tomarán ventaja de esta industria, incluso en esta forma primitiva, desde empresas que imprimirán a reproducciones de tu familia, hasta empresas especializadas en souveniles, y eso sin nombrar la cantidad de piezas fabricadas a la medida que veremos en todo tipo de industrias, desde la médica hasta el mercado de ropas y joyas. Definitivamente hoy dimos un paso más hacia esto y esto. Mientras tanto, las primeras leyes y demandas contra personas que impriman objetos tridimensionales sin autorización de sus creadores originales empezarán en 3, 2, 1... nota de prensa oficial página oficial de mcor Tecnologies página oficial de Staples varios videos sobre esta tecnología en acción Video a continuación (enlace YouTube)... autor: josé elías |

|

|

|

|

|

lunes, diciembre 3, 2012

|

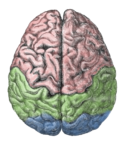

Investigadores canadienses acaban de revelar que han dado uno de los pasos más monumentales hacia la creación de inteligencias artificiales, creando un sistema al que llaman Spaun (o SPAUN por las siglas en inglés de "Semantic Pointer Architecture Unified Network"). Investigadores canadienses acaban de revelar que han dado uno de los pasos más monumentales hacia la creación de inteligencias artificiales, creando un sistema al que llaman Spaun (o SPAUN por las siglas en inglés de "Semantic Pointer Architecture Unified Network").Spaun es nada más ni nada menos que el primer modelo a gran escala que trata de simular todo el funcionamiento de un cerebro, aunque de forma primitiva, pero lo asombroso de este modelo es que totalmente por su cuenta es capaz de ver, recordar, pensar, razonar y escribir números. Y asombrosamente, su nivel de comprensión y deducción es casi tan bueno como el de seres humanos. Por ejemplo, sin entrenamiento previo, si se le presenta a Spaun estas dos secuencias de números: 1 2 3 5 6 7 ...y después se le presenta esta otra secuencia: 3 4 ? ...y se le pide que rellene el número que va en el "?", Spaun correctamente no solo identifica el número "5", sino que incluso provee la respuesta escribiéndola "a mano" (pues ha aprendido la forma en que se escriben los números). Noten que esto es algo que se hace sin pre-programar a Spaun para que entienda estos conceptos, sino que son sus propios patrones de reconocimiento y razonamiento internos los que lo llevan a deducir, de forma autónoma, la respuesta. En cuanto a cómo funciona Spaun, este fue construído no como una secuencia de programas "a fuerza bruta", sino que literalmente imitando un cerebro desde sus partes más primitivas. Spaun literalmente está compuesto de neuronas sintéticas que disparan cargas eléctricas, las cuales fluyen a través de neurotransmisores somo en cerebros biológicos. Incluso se modelaron varias partes del cerebro humano como son aquellas regiones que descodifican señales visuales (pues a Spaun no se le proveen las preguntas en un programa digital, sino que este literalmente "ve" con ojos sintéticos las preguntas que se le escriben), o las regiones encargadas de procesar movimientos (para poder escribir por ejemplo), o de memorizar, etc. Así que Spaun literalmente tiene que aprender no solo a entender el mundo por sus ojos, sino que deducir la simbología que aparece en su visión (como son los números escritos), y deducir su significado, así como extraer patrones, y después poder pensar por sí mismo el significado de toda esa información, y finalmente poder hacer hipótesis y buscar respuestas que termina expresando escribiéndolas. Pero quizás tan asombroso como todo esto es el hecho de que Spaun cometió los mismos tipos de errores comunes a seres humanos. Por ejemplo, al igual que nosotros, es mucho mejor en recordar los primeros o últimos números de alguna secuencia aleatoria, que a recordar toda la secuencia, entre otras idiosincracias de los seres humanos biológicos. Sin embargo, es bueno aclarar que este es apenas un primer paso, pues Spaun simula el equivalente a un segundo de actividad neuronal de un ser biológico, en varias horas, y por el momento sus poderes de razonamiento están limitados a simples números. Pero por otro lado, el hecho de que ya poseamos tecnología que nos permite crear este tipo de complejidad, nos dice que estamos ciertamente cerca (entre 2 a 5 décadas) de organismos sintéticos que posiblemente contengan el nivel intelectual de humanos, y cuando ese tiempo llegue, llegaremos a la cúspide de este escenario (en cuyo proceso ya estamos), y el mundo nunca volverá a ser igual... documento científico oficial el grupo encargado de crear a SPAUN más información relacionada (y software para construir tu propio cerebro) varios videos en YouTube fuente Video a continuación (enlace YouTube)... Actualización: Una conversación con los creadores de SPAUN (¡gracias Luis Gerardo por el enlace!) autor: josé elías |

|

|

|

|

|

lunes, noviembre 26, 2012

|

La ciencia ya lleva décadas interconectando cerebros humanos a máquinas de forma directa, utilizando electrodos y equipos especializados, pero todos estos sistemas sufren de lo mismo: Son demasiado grandes en relación a las neuronas que tratan de medir. La ciencia ya lleva décadas interconectando cerebros humanos a máquinas de forma directa, utilizando electrodos y equipos especializados, pero todos estos sistemas sufren de lo mismo: Son demasiado grandes en relación a las neuronas que tratan de medir.Eso significa que en vez de podernos conectar a una neurona en específico, lo que hacemos hoy día es conectarnos a grupos de ellas, y aunque eso de por sí es bastante útil, lo ideal sería poder "bajar" al nivel de las neuronas. Pues ese día a llegado. Científicos de la Universidad de Michigan han logrado crear unas nano-fibras de carbono que se conectan directamente al interior más íntimo de nuestro cerebro, y lo hacen porque son tan pequeñas, que miden apenas 7 micrones (0.007 milímetros) de espesor. Para que tengan una idea, eso es dos órdenes de magnitud (es decir, 100 veces), más pequeñas que los electrodos y sensores que utilizamos hoy día. Pero más asombroso aun, es que estos electrodos (que aun están siendo diseñados) no serán solo para uso temporal (digamos, mientras se le hace un exámen a un paciente), sino más bien para que puedan coexistir permanentemente con nosotros de por vida. En otras palabras, esto más allá de sus obvios fines médicos, abrirá las puertas a toda una nueva industria y generación de dispositivos que en esencia serían prótesis neuronales, que literalmente se fusionarán con nuestro cerebro para usos que hoy día escapan nuestra imaginación. Por ejemplo, quizás podamos utilizar estos implantes en un futuro para dotar a nuestro cerebro de sensores y funcionalidades que hoy día no poseemos (o que no son tan precisos como los sintéticos), como podría ser una brújula digital, o quizás el equivalente a una calculadora digital que nos permita "pensar" fórmulas y operaciones matemáticas y obtener un resultado inmediato, o incluso interconectar sensores y estimuladores directamente a nuestros nervios óptico y auditivo con el fin de grabar (en otro dispositivo conectado a nosotros) todo lo que nuestros ojos ven y oídos escuchan. Obviamente estas cosas para muchos suenan a ciencia ficción, pero les recuerdo una vez más, ¿qué hubiese respondido alguien hace 100 años si le hubiésemos dicho que dentro de 100 años tendríamos celulares que nos permitirían hacer video-conferencia con alguien al otro lado del mundo en tiempo real, o que tendríamos personas en la Luna, o naves que saldrían del Sistema Solar, o una red que conecta a 4 mil millones de personas de forma instantánea? Un paso más al NeuroPhone... documento científico oficial fuente secundaria autor: josé elías |

|

|

|

|

|

domingo, noviembre 25, 2012

|

|

Hoy los dejo con un asombroso video por Bruce Branit, el cual filmó las escenas con humanos en tan solo un día, pero después tardó 2 años en post-producción con los efectos digitales.

Como verán, valió la pena el resultado, y de paso este video nos ofrece un vistazo sobre cómo construiremos ambientes virtuales en el futuro. Y a propósito, esto encaja bastante bien con algo que escribí hace varios años atrás en eliax, en donde conjeturaba que las ciudades del futuro no se construirán y que seremos invisibles... ¡Gracias al lector identificado sencillamente como "Cristian" por el enlace al bello video! Video a continuación (enlace YouTube)... enlace original en Vimeo autor: josé elías |

|

|

|

|

|

sábado, noviembre 24, 2012

|

Cuando ves una obra de arte abstracta, ¿qué sientes? Cuando ves una obra de arte abstracta, ¿qué sientes?Esa es la pregunta que se hicieron científicos de la Universidad de Trento, y fueron más allá: ¿Podría una Inteligencia Artificial (IA) descubrir cuáles cosas sobre el arte abstracto causan una respuesta emocional en nosotros? Para averiguarlo, el equipo de curiosos científicos se dirigió hacia el Museum of Modern and Contemporary Art of Trento and Roverto e iniciaron un experimento... El experimento consistió en mostrarle 500 obras de arte abstracto a 100 personas, y preguntarles cómo los hizo sentir cada una de las obras, datos que fueron captados por una IA. Esto en esencia sirvió como un entrenamiento para la IA de lo que sienten los humanos ante ciertos patrones visuales. Lo increíble vino cuando posteriormente se le preguntó de forma independiente, tanto a humanos, como a la IA, el explicar como se sienten al ver nuevas obras de arte abstracto nunca antes vistas. El resultado fue que la IA pudo adivinar, con un 80% de certeza, la respuesta emocional que iban a tener los humanos ante las nuevas obras de arte. La IA incluso pudo notar patrones psicológicos que los humanos ya sabíamos, como por ejemplo el hecho de que colores oscuros con ángulos rectos provocan sentimientos negativos, mientras que colores más vivos con ángulos suavizados provocan sentimientos positivos. Pero como notan los investigadores de este estudio, el propósito de esto no es hacer una IA con sentimientos humanos, sino más bien el poder crear una IA que pueda generar contenido al cual los humanos nos podamos sentir atraídos. Yo por mi parte lo que puedo decirles es que esto es sencillamente más evidencia hacia un par de temas recurrentes acá en eliax: 1. Incluso las cosas más abstractas, irracionales, sentimentales, subjetivas y/o intangibles, tienen un trasfondo que se puede analizar racional y matemáticamente. 2. Los humanos somos máquinas, y bastante predecibles. El hecho de que con tan pocos datos una IA pueda deducir con un 80% de certeza la respuesta emocional que un humano tendrá ante una obra de arte, nos dice que la mayoría de nosotros seguimos los mismos patrones y reaccionamos de forma similares a los mismos estímulos (como cualquier otra máquina). Así que ya lo saben, el próximo Pablo Picasso podría muy bien ser una máquina escondida en algún laboratorio universitario... fuente autor: josé elías |

|

|

|

|

|

jueves, noviembre 8, 2012

|

Hoy día se hace cada vez más popular el rentar espacio en máquinas virtuales (o "VM", por sus siglas en inglés) en empresas dedicadas a estos servicios (como Amazon, GoDaddy, RackSpace, etc), y la idea es que estas VMs funcionan varias de ellas en un mismo servidor físico. Hoy día se hace cada vez más popular el rentar espacio en máquinas virtuales (o "VM", por sus siglas en inglés) en empresas dedicadas a estos servicios (como Amazon, GoDaddy, RackSpace, etc), y la idea es que estas VMs funcionan varias de ellas en un mismo servidor físico.En teoría, cada una de estas VMs se comporta como una máquina totalmente aparte de las otras VMs que estén en el mismo hardware, así que por ejemplo, es posible tomar un servidor de 4 núcleos y 16GB de memoria, y particionarlo de modo que se creen 4 VMs de 1 núcleo y 4GB de memoria cada una. Al hacer esto es incluso posible instalar distintos sistemas operativos en cada una, y para todos los fines prácticos son 4 máquinas distintas. El aislamiento es tal, que estas máquinas en teoría ni la más remota idea tienen de que existen otras VMs en el mismo hardware, y muchos menos saber a quien le pertenecen esas otras VMs, o qué procesos están ejecutando. Esto se logra gracias a una técnica llamada un HyperVisor de Tipo 1 (que expliqué lo que era hace 3 años acá mismo en eliax), el cual es un software especializado que se sienta entre el hardware y las VMs, permitiendo que estas se comporten como hermanas. Pues la noticia de hoy es que un grupo de científicos ha logrado demostrar, en un ambiente controlado por el momento, que es posible que una VM investigue lo suficiente como para obtener información de otras VMs en el mismo hardware. En el caso específico demostrado, este grupo de científicos logró obtener una llave digital de cifrado de otra VM, y lo hizo sin "hackear" la otra VM, o incluso sin entrar a la otra VM, y sin saber absolutamente nada de la otra VM. ¿Cuál fue el truco? Pues monitorear el contenido el cache L1 (un tipo y/o área especial de memoria que se utiliza para almacenar datos frecuentemente utilizados), escribiendo datos y leyendo datos con el único propósito de ver cuáles de sus propios datos eran sacados del cache (lo que le da un indicio de que otra VM está utilizando ese espacio), y después aplicando unos algoritmos de procesamiento para notar patrones de acceso en el cache. Para acortar la historia, este equipo demostró poder obtener suficientes "bits" de una llave digital como para poder reconstruirla en menos de 10,000 intentos (que en términos de computación, es trivial hacer, en menos de 1 segundo en cualquier procesador barato). ¿Qué significa esto? Que de ahora en adelante hay que pensarlo dos veces para entidades que dependan mucho de seguridad (como datos estatales, bancos, etc), antes de rentar estos servidores virtuales, pues nunca se sabe quien será tu vecino en estas VMs. La solución a este tema es obviamente no rentar VMs sino que servidores físicos bajo tu control (aunque como este mismo artículo demuestra, nada es 100% seguro). Pero ojo, tampoco es para entrar en pánico. Aunque todo esto fue demostrado como que funciona, lo cierto es que todo fue realizado en un ambiente bastante controlado, y los investigadores de esta técnica aclaran que en un ambiente de producción normal esto es algo extremadamente difícil lograr, aunque ciertamente bajo el alcance de organizaciones con grandes fondos para invertir en los recursos necesarios para llevarlo a cabo (citan naciones-estados como los candidatos número uno a utilizar esto). Sin embargo, de esto poder llevarse a cabo, esto podría permitirle a alguien por ejemplo averiguar claves privadas de cifrado RSA (con SSL por ejemplo), lo que le permitiría falsificar documentos y conexiones, así como observar una linea de comunicación sin ser detectados, entre otros usos. documento científico (PDF) fuente autor: josé elías |

|

|

|

|

|

domingo, noviembre 4, 2012

|

|

Hoy quiero dejarlos a que ponderen este video, que quiero sintetiza muchos de los sentimientos que por años he expresado en eliax con respecto al rol de la tecnología en nuestras vidas.

El video es de una charla de Lasse Birk Olesen, en donde expresa como lo que mueve la sociedad en el gran orden de las cosas es por lo general la tecnología, y no la política. Es decir, por más decisiones, restricciones, condiciones y leyes que se impongan, por lo general la tecnología habilita a la sociedad a sobreponerse a todas esas cosas para que naturalmente las cosas se den independientemente de las leyes o restricciones impuestas por regímenes políticos o religiosos. No dejen de ver el video, es solo de unos pocos minutos, y estén de acuerdo o no con lo dice al menos les enriquecerá la mente poniéndolos a contemplar cosas en las cuales quizás no habían pensado antes. Video a continuación (enlace YouTube)... autor: josé elías |

|

|

|

|

|

lunes, octubre 29, 2012

|

Científicos del ATR Computational Neuroscience Laboratories en Kyoto, Japón, acaban de dar un tremendo avance en materia de descodificación de sueños, al inventar una técnica que permite dejarles saber en qué están soñando las personas. Científicos del ATR Computational Neuroscience Laboratories en Kyoto, Japón, acaban de dar un tremendo avance en materia de descodificación de sueños, al inventar una técnica que permite dejarles saber en qué están soñando las personas.La técnica en su forma sencilla de explicar es la siguiente: Se utilizan varias personas para el estudio, las cuales son despertadas varias veces durante una misma noche (cuando se sabe que están soñando) y se les pregunta que reporten con qué estaban soñando en ese preciso momento. Las respuestas de estas personas son grabadas junto con los patrones cerebrales de ellos en regiones del cerebro llamadas V1, V2 y V3, que son algunas de las primeras regiones de cerebro que procesan la visión en humanos. Esto produce patrones que por ejemplo pueden asociar algo como "soñando con una mujer" o "utilizando una computadora" con un patrón específico. Posteriormente a esa etapa de "entrenamiento", las personas vuelven a dormir, y estas ves los científicos los despiertan pero tratan de adivinar en qué estaban soñando las personas en forma cruda, basados en un sistema de reconocimiento de patrones. Asombrosamente, en algunos casos se logran entre un 75 a un 80% de certeza en adivinar en qué estaban soñando las personas, aunque aclaremos que esto está aun en una etapa primitiva, pues solo reconoce cosas bastante simples y no eventos complejos con lujo de detalles. El estudio de paso arrojó el conocimiento de que parece que nuestros sueños ligan tanto la parte visual de nuestro cerebro (cosa que muchos sospechábamos) como la memoria de corto plazo, lo que me hace pensar que a eso se deberá lo rápido que olvidamos por lo general nuestros sueños. Este adelanto me pone a pensar, ¿qué sucedería si combinamos esta nueva técnica, con esta otra reciente que graba directamente del cerebro lo que tu mente está viendo? El resultado sería el DreamCorder del cual les hablé el año pasado... fuente autor: josé elías |

|

|

|

|

|

sábado, octubre 27, 2012

|

|

La empresa Boston Dynamics no deja de sorprenderme.

Después de traernos robots como este y este, ahora nos dan una demostración del Pet-Proto, un robot que a algunos le dará incluso miedo ver, pues estoy seguro que les traerá memorias de las películas de Terminator... Este robot tiene la particularidad de que aparte de ser humanoide, puede maniobrar de forma totalmente autónoma por todo tipo de terreno, incluyendo escombros, agujeros, etc, como podrán apreciar en el increíble video. Esta investigación está apoyada por DARPA (los mismos que inventaron el Internet y encargados de la defensa de los EEUU), con el obvio propósito de fines militares, pero como podemos imaginarnos llegará un momento en que esta tecnología (en su versión perfeccionada) llegará a manos de civiles, y hará los robots muchísimo más útiles y versátiles que en la actualidad, pudiendo estos no solo ayudar en hospitales y hogares, sino que además en labores de rescate en medio de desastres naturales. ¡Gracias al lector Harold Alberto Tascón por compartir el enlace en el grupo oficial de eliax en Facebook! Video a continuación (enlace YouTube)... autor: josé elías |

|

|

|

|

|

jueves, octubre 25, 2012

|

Un grupo de científicos de varias universidades (entre ellas MIT, Harvard y Caltech) acaban de crear, y probar exitosamente, una nueva técnica para transmisión de datos que permitirá acelerar el transporte de datos inalámbricos (como en redes WiFi o celulares) en al menos un 1000%. Un grupo de científicos de varias universidades (entre ellas MIT, Harvard y Caltech) acaban de crear, y probar exitosamente, una nueva técnica para transmisión de datos que permitirá acelerar el transporte de datos inalámbricos (como en redes WiFi o celulares) en al menos un 1000%.La técnica, que es bastante fácil de implementar (incluso en la generación actual de routers) consiste en reducir drásticamente la cantidad de paquetes de datos que se pierden (debido a muchos factores, incluyendo el hecho de que tales paquetes compiten con muchos otros paquetes más), utilizando un técnica que en esencia crea redundancia en los datos enviados. Esa redundancia se logra con unos sencillos algoritmos algegraicos que en esencia permite deducir cuáles son los datos de los paquetes perdidos con solo ver los paquetes ya recibidos. Esto es un poco similar al concepto de RAID-5 en almacenamiento, en donde uno utiliza al menos 4 discos duros, pero si falla uno no importa ya que se puede deducir los datos del cuarto disco con cualquiera otro de los tres. La técnica también toma prestado un poco de algoritmos de compresiones de video en donde algunos de esos algoritmos no almacenan cada pixel a renderizar en pantalla, sino que almacenan el equivalente a una fórmula matemática la cual define el grupo de pixeles (esa es también la razón por la cual en algunos formatos de video es posible escalar la imagen a una resolución de pixeles mayor al formato original, y sacar detalle adicional de la imagen). En pruebas creadas con esta técnica, el tráfico real (en el campus de MIT) de WiFi pasó de un promeio de 1Mbps en su red pública, a 16Mbps. Y en medio de un tren en movimiento el ancho de banda aumentó desde 0.5Mbps a 13.5Mbps. Como se podrán imaginer, esto tendrá grandes repercusiones no solo en redes locales en hogares y negocios, sino que en redes públicas de Internet, así como en redes celulares en donde pronto podríamos tener Internet al menos 10 veces más rápido con el mismo equipo de hardware actual. Y reitero, esto ya pasó de etapa teórica a la experimental en ambientes reales, por lo que la tecnología llegará bastante rápido al mercado (los inventores de esto ya han licenciado el invento a varias empresas de telecomunicaciones). fuente documento científico oficial Actualización: Aclaré en el artículo que esta técnica es exclusiva para redes inalámbricas como WiFi o celular, y no para redes alambradas. autor: josé elías |

|

|

|

|

|

miércoles, octubre 24, 2012

|

Hoy los dejo con este interesante (aunque quizás, demasiado detallado) video titulado "True Skin" ("Piel Verdadera"), creado por N1ON, en donde nos muestran visualmente como podría ser un futuro no muy lejano de la Humanidad 2.0 que tanto menciono en el blog... Hoy los dejo con este interesante (aunque quizás, demasiado detallado) video titulado "True Skin" ("Piel Verdadera"), creado por N1ON, en donde nos muestran visualmente como podría ser un futuro no muy lejano de la Humanidad 2.0 que tanto menciono en el blog...Yo particularmente no me suscribo al futuro que vemos en el video parecido más a Blade Runner que la realidad que vivimos, pero aun así el video es interesante por varios motivos. Primero, nos da aunque sea un breve vistazo a las modas del futuro, y al hecho de que cualquiera podrá modificar su apariencia externa e interna. En esencia, y como ya he explicado por años en el blog, nos fusionaremos con nuestra tecnología. Segundo, trata de forma colateral e indirecta el tema de que en un futuro lleno de Humanos 2.0, es posible que se discrimine contra "Naturales" o "Humanos 1.0", en el sentido de que estos no podrán ejercer tan eficientemente en la sociedad como el resto de la población modificada. Y tercero, trata el tema de respaldos de mentes, en forma similar a varios artículos de eliax y como expliqué en detalle en mi libro del 2001 Máquinas en el Paraíso. No dejen de verlo, está muy bien realizado el video... ¡Gracias Lanello Carrau por el enlace al video! Video a continuación (enlace YouTube)... Actualización: Warner Bros ha obtenido los derechos para expandir este video a una película de larga duración (con el mismo equipo que hizo el video). ¡¡¡Felicidades y esperemos que la película valga la pena verse!!! :) autor: josé elías |

|

|

|

|

|

martes, octubre 23, 2012

|

Uno de los grandes deseos de la humanidad (de hace tanto tiempo que incluso en la Biblia ya se hablaba de la Torre de Babel) era el poder tener un medio por el cual uno pudiese hablar en un lenguaje y que de alguna manera nos entendieran otras personas en otro lenguaje, en tiempo real, similar a las tecnologías utilizadas en series de ciencia ficción como en Star Trek (Viaje a las Estrellas). Uno de los grandes deseos de la humanidad (de hace tanto tiempo que incluso en la Biblia ya se hablaba de la Torre de Babel) era el poder tener un medio por el cual uno pudiese hablar en un lenguaje y que de alguna manera nos entendieran otras personas en otro lenguaje, en tiempo real, similar a las tecnologías utilizadas en series de ciencia ficción como en Star Trek (Viaje a las Estrellas).Y hoy me complace decirles que la tecnología ya se ha hecho realidad, y entra en producción para su uso masivo en Noviembre próximo en Japón gracias al gigante de telecomunicaciones de esa nación NTT DoCoMo. Esta es la versión final de la misma tecnología de NTT DoCoMo de la cual les informé hace un tiempo atrás, y lo que hace parece milagroso: Haces una llamada telefónica, y después de especificar el lenguaje de la traducción, hablas normalmente en tu idioma y en el otro extremo del teléfono una voz sintética va hablando junto contigo (en tiempo real) lo mismo que dices pero en el idioma al que deseas traducir. En otras palabras, si un japonés te llama desde Japón, la empresa puede hacer que escuches una voz hablándote en español, mientras que la otra persona en Japón escucha una voz habándole en Japonés, todo en tiempo real mientras hablas. Ojo, que obviamente debido a las particularidades de cada idioma, en donde algunos verbos y adjetivos se ponen al revés, que el sistema no es 100% en tiempo real, sino que es "casi en tiempo real", en el sentido de que va traduciendo conforme tenga suficientes datos sintácticos y semánticos para traducir. Sin embargo, en la práctica podemos decir que es tiempo real ya que la traducción se va haciendo mientras el sistema te va entendiendo. El sistema arranca el 1ro de Noviembre traduciendo entre Japonés e Inglés, Coreano o Mandarín (Chino), pero para finales de mes también habilitarán Español, Portugués, Italiano, Francés, Alemán, Tailandés e Indonesio. Veamos ahora cuánto tiempo transcurre antes de que esta tecnología esté disponible en todos los países del mundo... :) fuente oficial autor: josé elías |

|

|

|

|

|

domingo, octubre 21, 2012

|

En Septiembre del 2010 el Director del prestigioso periódico The New York Times anunció que la empresa entraría en un período de transición donde dejarían la versión impresa por la digital, y ahora estamos empezando a ver un proceso similar en el mundo de las revistas... En Septiembre del 2010 el Director del prestigioso periódico The New York Times anunció que la empresa entraría en un período de transición donde dejarían la versión impresa por la digital, y ahora estamos empezando a ver un proceso similar en el mundo de las revistas...Como una clara señal de los tiempos, la reconocida revista Newsweek, después de 80 años en circulación, anunció recientemente de forma sorpresiva (o quizás no tan sorpresiva, dada la clara tendencia del mercado) que cerrará su versión impresa sobre papel el 31 de Diciembre de este año 2012 en curso. De ahora en adelante Newsweek estará disponible exclusivamente en formato digital por la web, el iPad, y otras plataformas futuras. Este es un buen momento para leer el editorial del 2010 en eliax titulado 10 razones de por qué el romanticismo no va a salvar a los medios impresos, así como el otro editorial del 2009 titulado Ultimátum a los medios impresos tradicionales. fuente autor: josé elías |

|

|

|

|

en camino a la singularidad...

©2005-2026 josé c. elías

todos los derechos reservados

como compartir los artículos de eliax

Seguir a @eliax