Software

|

lunes, abril 14, 2014

|

Al menos que hayan estado viviendo en una cueva en estos días pasados, o de vacaciones (como es mi caso, y que decidí interrumpir brevemente para hablarles de este importance tema), es bastante posible que hayan escuchado sobre "Heartbleed" al menos unas cuantas veces en estos días, y los menos técnicos quizás se estén preguntando ¿qué es esa cosa, cómo funciona y cómo me afecta? Así que hoy les respondo a esas preguntas de forma breve y fácil de entender en un formato eliaxístico... Al menos que hayan estado viviendo en una cueva en estos días pasados, o de vacaciones (como es mi caso, y que decidí interrumpir brevemente para hablarles de este importance tema), es bastante posible que hayan escuchado sobre "Heartbleed" al menos unas cuantas veces en estos días, y los menos técnicos quizás se estén preguntando ¿qué es esa cosa, cómo funciona y cómo me afecta? Así que hoy les respondo a esas preguntas de forma breve y fácil de entender en un formato eliaxístico...Para empezar, es bueno entender que a lo que esto afecta es a un componente llamado "OpenSSL" que implementa el protocolo "SSL" que todos utilizamos al navegar de forma segura el Internet. SSL es la tecnología responsable de presentar el "candadito" que vemos en nuestros navegadores cada vez que nos conectamos a páginas con datos cifrados (como cuando entramos nuestro usuario y clave para revisar nuestros correos o entrar a alguna red social), con la finalidad de que tales datos no sean interceptados y leídos por cualquier intermediario en Internet. Por su parte, OpenSSL es un programa o software que implementa el protocolo SSL en servidores web (como el popular Apache). Si SSL es el idioma seguro del Internet, OpenSSL es la persona que habla ese lenguaje en el lado opuesto de nuestro navegador web. Es bueno notar que así como varias personas pueden hablar un idioma, que así mismo pueden haber varios programas/software que implementen el protocolo SSL, por lo que es importante entender que OpenSSL es apenas uno de esos programas, ya que existen otros. Sin embargo, OpenSSL es la implementación de SSL más popular del mundo, y se estima que al menos el 60% de los servidores web lo utilizan, y el problema del Heartbleed es un problema que afecta directamente a OpenSSL, por lo que en teoría al menos el 60% del Internet está en riesgo (en unos instantes les explico en riesgo de qué, específicamente). Sin embargo, en la práctica la cifra de sistemas afectados es mucho menor, con estimados que rondan el 17%, ya que no todo el mundo utiliza la misma versión de OpenSSL, y sólo una versión reciente muy específica es la que ha sido afectada (y corregida en una actualización más reciente aún). Pero, ¿cómo exactamente funciona Heartbleed y cómo nos afecta? Pues sucede que parte del protocolo SSL es mantener una conexión abierta entre el servidor web y quien sea que se conecta a este de modo seguro (como tu navegador web con el candadito), y uno de los mecanismos que el protocolo utiliza es el de mantener un "latido" digital entre ambos extremos, en donde por ejemplo tu navegador web cada cierto tiempo le informa al servidor web "aún estoy vivo", de paso pidiendo cierta información al servidor web. Y el problema está precisamente en ese instante del protocolo en donde el navegador web le pide información al servidor web... Sucede que en esa parte del protocolo, los datos que el servidor te envía son medidos exactamente, de modo que por ejemplo si el servidor te envía unos datos que ocupan 1024 caracteres (o "1 KB" en términos técnicos, asumiendo 1 Byte por carácter), este no sólo te envía esos datos sino además una descripción de su tamaño en sí (esto se hace por motivos de eficiencia y de poder saber que recibiste la cantidad correcta de datos). Sin embargo, alguien descubrió que en una versión específica de OpenSSL es posible pedirle al servidor web más datos de los que estás supuesto a recibir. Específicamente, un hacker que haya creado una versión especial de un navegador web puede pedir hasta 64KB (sobre 65,000 caracteres) de datos contiguos de su memoria. ¿Qué significa eso de 64KB continuos de la memoria? Pues este es el corazón del asunto... Sucede que un servidor web típico por lo general interactúa con miles de personas a la vez, por lo que en su memoria temporal se encuentran rastros de todas sus operaciones e interacciones recientes con los usuarios. Eso significa que dentro de la memoria interna del servidor, justo al lado de los datos de otra persona pueden estar almacenados temporalmente las últimas operaciones que hayas realizado con tu navegador web, en donde una esas operaciones bien pudo haber sido la de proveer tu usuario y clave al servidor para tener acceso a alguna cuenta tuya. ¿Qué significa eso? Pues significa que si un hacker justo después de ti le pide al servidor que le provea no sólo sus datos, sino los 60 mil y pico de caracteres que le siguen en su memoria interna, que hay una cierta posibilidad de que obtenga los datos de tu usuario y clave (que internamente en la memoria del servidor se almacenan sin cifrado alguno). Esto podría aparentar que es algo difícil para un hacker poder explotar, ya que el hacker tendría que interactuar con el servidor justo después de ti, pero en la práctica la realidad es que se le hace relativamente trivial a un hacker explotar esta falla, ya que lo único que tiene que hacer es automatizar un proceso que constantemente (varias veces por segundo, 24 horas al día) le pida 64KB de datos al servidor, con el fin de aumentar sus posibilidades considerablemente de caer justo en el preciso momento en donde la memoria de tu conexión yace al lado o en la cercanía de la memoria del proceso maligno. Esto tiene como consecuencia que es imperativo que cambies tu clave si no la has cambiado en semanas recientes, ya que sí has accedido a un portal web que aún no haya arreglado esta vulnerabilidad, entonces estás en riesgo de que algún hacker ya sepa tu clave... Pero, ¿cómo saber si una página que frecuentas aún no ha corregido esta falla? Pues una manera es con esta herramienta web, la cual te pide la dirección de Internet de una página, y este te revisa si esa página es vulnerable o no al Heartbleed. Finalmente, para los curiosos, si se preguntan de dónde sacaron ese nombre, pues tiene que ver con que en el protocolo SSL la palabra "latido" en inglés es "beat", y "latido de corazón" es "heartbeat", y dado que este problema lo que hace es "desangrar" tus datos, le pusieron "Heartbleed", que literalmente significa "desangrado de corazón"... autor: josé elías |

|

|

|

|

|

viernes, abril 11, 2014

|

¿Alguna vez te has preguntado como te verás dentro de X cantidad de años? Pues eso mismo se preguntaron unos investigadores de la Universidad de Washington en los EEUU, y crearon un increíble software que permite predecir con asombrosa precisión cómo te verás dentro de una cantidad específica de años. ¿Alguna vez te has preguntado como te verás dentro de X cantidad de años? Pues eso mismo se preguntaron unos investigadores de la Universidad de Washington en los EEUU, y crearon un increíble software que permite predecir con asombrosa precisión cómo te verás dentro de una cantidad específica de años.El software incluso puede tomar una foto tuya de cuando tenías apenas 2 o 4 años, y decirte como te verás a los 60 o incluso 80 años. Pero, ¿cómo sabemos que funciona? Pues comprobando los resultados con fotografías de personas ancianas de quienes también tenemos fotografías de cuando eran jóvenes, para ver si el programa puede predecir la apariencia de hoy día basado en la fotografía de hace varias décadas atrás. Y lo asombroso es que los resultados son muy cercanos a la realidad. Esto, más allá de su potencial como una herramienta curiosa, tiene usos prácticos que nos podemos imaginar, como por ejemplo para predecir cómo se verían personas hoy día que de niños fueron raptados o perdidos, así como podría también utilizarse para encontrar terroristas de quienes solo poseemos fotografías en edades mucho más jóvenes. Otro uso que me imagino que se le puede dar a esto es utilizar el software al revés, empezando con una cara reciente y tratando de predecir cómo te verías de niño. Esto por ejemplo podría ser utilizado por empresas de redes sociales como Facebook u otra red social para automáticamente etiquetar fotos de nosotros de cuando éramos mucho más jóvenes. Pero más allá de esos usos, yo por el momento lo que desearía es que liberaran este software como una aplicación web o móvil, para que cada uno de nosotros podamos ver como nos veríamos nosotros mismos, así como nuestros familiares, amigos y conocidos, dentro de unos años... :) página oficial del estudio autor: josé elías |

|

|

|

|

|

martes, abril 8, 2014

|

Hace 6 años que Microsoft iba a retirar a Windows XP, pero lamentablemente para la empresa año tras año se ha visto forzada a seguir manteniendo el venerable sistema operativo, pero después de posponer varias veces lo inevitable, el día ha llegado, y hoy es la fecha final de Microsoft soportar a Windows XP. Hace 6 años que Microsoft iba a retirar a Windows XP, pero lamentablemente para la empresa año tras año se ha visto forzada a seguir manteniendo el venerable sistema operativo, pero después de posponer varias veces lo inevitable, el día ha llegado, y hoy es la fecha final de Microsoft soportar a Windows XP.¿Qué significa eso? Pues el mundo no se va a acabar mañana, pero sí significa que desde hoy ya Microsoft no trabajará más con XP, por lo que no lanzará más actualizaciones de funcionalidad o de seguridad. Y es esa parte de la "seguridad" lo que preocupa a muchos, ya Windows XP (al igual que prácticamente todas las versiones de Windows) a demostrado ser un magneto para todo tipo de programas malignos, por lo que si los hackers descubren (y lo harán) nuevas vulnerabilidades en Windows XP, eso significa que los usuarios estarán totalmente por su cuenta. Noten que si tienen un antivirus actualizado que eso los permitirá protegerse un poco de posibles problemas, pero en el momento que se encuentren vulnerabilidades innatas a XP mismo, y que circunnaveguen cualquier antivirus, que todo usuario de XP estará expuesto a los deseos de los hackers... Entonces, ¿qué pueden hacer ahora? Pues eso depende para lo que utilices XP... Si eres un usuario empresarial que tiene aplicaciones que dependen de Windows, la única opción viables es migrar a un Windows más reciente. Mi recomendación para el sector empresarial es migrar hacia Windows 7, el cual es relativamente reciente y tiene un interfaz muy similar al de Windows XP, por lo que los empleados podrán pasar al nuevo Windows con un mínimo de entrenamiento. Sin embargo, antes de migrar asegúrense de (1) hacer respaldo de todos los datos en la PC, y (2) asegurarse que las aplicaciones que utilizan en Windows XP ya están adaptadas o sean compatibles con Windows 7 (lo más probable es que sí, al menos que sean aplicaciones bien viejas o desarrolladas con herramientas obsoletas hoy día). Por otro lado, si utilizas a XP exclusivamente para navegar el Internet y/o utilizar Microsoft Office, ver videos, y escuchar música (o en otras palabras, si no dependes de algunas otras aplicaciones específicas a Windows) entonces tienes otras opciones... La primera opción (más allá de migrar a otra versión de Windows, que es la opción más obvia) sería migrar o a Linux o a Mac OS X. Si migras a Linux, es casi seguro que podrás seguir utilizando tu misma PC, y solo tendrás que instalar a Linux de forma similar a como instalas a Windows. Sin embargo, es bueno que esto lo haga un técnico que sepa lo que hace, pues aunque Linux ha evolucionado muchísimo, y en muchos aspectos es bastante similar a Windows, lo cierto es que es fácil confundirse con tantas opciones disponibles, ya que literalmente existen decenas de variantes de Linux (llamadas "distribuciones"). Si van a adoptar a Linux recomiendo investigar y adoptar solo una de las distribuciones más populares. Una que recomiendo es Ubuntu. Y noten que todas las distribuciones de Linux son gratis y libre de licencias, aunque empresas como Red Hat ofrecen también planes corporativos pagados con soporte técnico. Otra opción es adoptar a Mac OS X, pero eso conlleva a invertir en una nueva máquina, y es bueno notar que las máquinas de Apple cuestan por lo general más que las equivalentes de Windows/Linux, sin embargo ofrecen la mejor estabilidad del mercado, actualizaciones gratuitas a las nuevas versiones de los sistemas operativos OS X, vienen con unas aplicaciones llamadas iWork y iLife que son excelentes, y además son rápidas, eficientes, fáciles de utilizar, y se integran super fácilmente con todo el ecosistema de Apple (iPhone, iPod Touch, iPad, iTunes, etc). Noten que si quieren mudarse al mundo Apple con OS X que no es necesario comprar una costosa iMac, MacBook Air, o MacBook Pro, ya que la empresa ofrece la Mac Mini... La Mini es una Mac completa, pero a la cual debes conectarle tu propio monitor, teclado y ratón, por lo que si ya tienes esos componentes de tu vieja PC, esta es una opción viable que te costará unos US$599 dólares (o mucho menos si compras la Mini usada o de una generación anterior). Nota que si te vas por la ruta usada, que recomiendo revisar que lo que compres sea compatible con la más reciente versión de OS X, la llamada "Mavericks" o "10.9", ya que equipos muy viejos no son compatibles. Noten además que en OS X puedes obtener una gran variedad de las mismas aplicaciones de Windows, particularmente en el sector creativo, con aplicaciones como Photoshop y Dreamweaver funcionando incluso mejor en OS X que en Windows (razón por la cual Apple ha creado todo un nicho del sector creativo con OS X). Otro punto a considerar es que tanto en Linux como en Mac OS X es posible ejecutar aplicaciones clásicas de Windows de forma emulada, de modo que dentro de OS X puedes ejecutar aplicaciones de Windows. en Linux una opción gratis que tienes es VirtualBox, pero lo mejor que he visto es lo que hace la aplicación Parallels Desktop en Mac OS X (hay que pagar por el producto), con el cual nunca he tenido un solo problema de compatibilidad con Windows, y asombrosamente las aplicaciones ejecutan a velocidad virtualmente igual a las originales. En ambos casos (Linux o Mac) sin embargo, si necesitan trabajar con documentos como los de Office de Microsoft, tienen varias opciones... Una opción es OpenOffice (y su descendiente, LibreOffice), que es una versión compatible con el 98% de lo que planean hacer con Office, y abre, genera y modifica documentos de Office. Yo mismo le he dado uso por años e instalado en varios familiares y funciona muy bien. Y lo mejor es que es gratis y disponible para Windows, Linux o Mac OS X. Otra opción es Google Drive (antes llamado Google Apps). Estas son aplicaciones que todo usuario de GMail tiene (aunque muchos lo desconocen) que recrean una versión compatible de Office dentro del navegador web en sí, y funciona de maravilla (es lo que personalmente utilizo en el 95% de los casos). Esta solución de Google funciona en cualquier plataforma desde donde exista una navegador web moderno, y uno de sus grandes beneficios es que los documentos que creas se crean "en la nube" de Google, por lo que siempre están disponibles desde cualquier parte del mundo en cualquier momento, con tu solo entrar tu usuario y clave de GMail. Aparte de eso esta herramienta permite que compartas tus documentos y colabores con otros en tiempo real (literalmente vas viendo las letras y demás cosas que otros hacen en el documento que tienes abierto). Lo único malo de esta solución es que para sacarle provecho es bueno tener una conexión constante a Internet (que hoy día no es problema en la mayoría de empresas), aunque es bueno notar que Google ofrece extensiones (particularmente útiles con su navegador Google Chrome) que permite trabajar en documentos aun no tengas Internet (estos después automáticamente se sincronizan desde que notan que te conectas a Internet otra vez). Noten que Microsoft ofrece algo similar llamado Office 365, que ofrece una versión web de Office que funciona dentro de tu navegador, y que similar a Google te permite almacenar tus documentos en la nube y colaborar con otros, pero viene con la salvedad de que requiere de una subscripción mensual o anual, aunque puedes estar seguro que la solución de Microsoft será más compatible que las otras soluciones, aunque en la práctica eso será solo de importancia a una vasta minoría, ya que el 98% de los archivos de Word y Excel abren perfectamente en las otras soluciones compatibles. Otra opción diferente para los usuarios casuales es dejar atrás al mundo de la PC por completo, y adoptar una tableta. Personalmente, la tableta que recomiendo es el iPad Air de Apple, que ha madurado muchísimo mejor que las equivalentes tabletas Android, y ofrece una experiencia de usuario superior a los consumidores, aunque como siempre, a un precio "premium". Otra opción es el iPad Mini con Retina, aunque noten que incluso un iPad 3 usada será mucho más que suficiente para la persona promedio, y se pueden conseguir en buen precio. Noten que Google Drive está disponible gratuitamente en iPad, y que Apple también hace disponible gratuitamente iWork (el equivalente de Office por parte de Apple) en iPad, y que Google no hace mucho adquirió a QuickOffice para iPad (que también hizo gratis y que también ofrece compatibilidad con Office), y que Microsoft también ofrece aplicaciones nativas de Office para iPad (que son excelentes). Finalmente, otra opción que tienes son las Chromebooks de Google (pero vendidas por diferentes fabricantes, como Samsung). Estas son máquinas ultra-ligeras, parecidas a las laptops MacBook Air de Apple, de muy bajo costo generalmente (por entre US$200 a US$400), y que esencialmente son "una navegador web en una PC". Estas Chromebooks son en esencia una máquina que solo ejecutan el navegador web Chrome de Google, por lo que desde que arrancas la máquina entras a lo que se parece es Chrome, aunque obviamente con ciertas modificaciones. Desde una Chromebook sin embargo tus opciones son un poco limitadas ya que solo puedes trabajar con aplicaciones conectadas a Internet (con unas cuantas excepciones como Google Drive, como explicado unos párrafos anteriores), por lo que dependes o de aplicaciones de la tienda de Chrome de Google, o de aplicaciones web. Sin embargo, para la empresa que solo necesite acceso a una navegador de Internet, y editar documentos promedios de Office, esta es una alternativa viable y de bajo costo, y cuya oferta solo mejorará con el tiempo, conforme veamos más y más aplicaciones que solo necesitan un navegador web y no necesitan ser instaladas localmente (como es la tendencia global). Así que esas son sus opciones. Feliz migración (si se puede decir eso)... :) autor: josé elías |

|

|

|

|

|

domingo, marzo 30, 2014

|

Una de las grandes noticias de esta semana fue sin duda la salida de Microsoft Office para el iPad (que anuncié vía @eliax en Twitter tan pronto se dio el hecho), algo que para muchos vino de sorpresa, al menos claro, que sean lectores veteranos de eliax y ya esperaban esto este año... Una de las grandes noticias de esta semana fue sin duda la salida de Microsoft Office para el iPad (que anuncié vía @eliax en Twitter tan pronto se dio el hecho), algo que para muchos vino de sorpresa, al menos claro, que sean lectores veteranos de eliax y ya esperaban esto este año...Pero antes de continuar, es bueno aclarar un poco de confusión (introducida inadvertidamente por la misma Microsoft): Esta es la primera versión completa de Office para una plataforma fuera de Windows y Mac OS X. Las versiones que actualmente existen para el iPhone y Android no son una versión real de Office, sino que una versión "móvil" que carece de la gran mayoría de funcionalidades de la verdadera versión de Office, que es la que acaba de salir para el iPad. En otras palabras, si han probado la versión del iPad, o la de Android, noten que esta es una versión totalmente diferente y nueva, y es realmente la versión "real" de Office, y como si fuera poco, no es una versión basada en una versión actual, sino que Microsoft se tomó su tiempo y programó a Office para iPad totalmente y literalmente desde cero, por lo que es una versión muy estilizada, rápida, y casi tan poderosa como la versión de escritorio. Esa es la razón por la cual las versiones de iPhone y Android son completamente gratis y no requieren una subscripción al servicio Microsoft Office 365, mientras que la versión del iPad sí (aunque tienes la opción de no subscribirte y poder ver documentos sin oportunidad de modificarlos o crear nuevos). Noten que una subscripción de Office 365 cuesta o US$10 dólares mensuales, o US$100 anuales (si lo pagan todo por adelantado), y que aunque para muchos suene un poco caro, lo cierto es que esa subscripción es válida para 5 usuarios de iPads más 5 usuarios de Windows o Mac. Es decir, por ese precio no solo obtienes 5 licencias para iPads, sino que 5 licencias para las versiones de escritorio para Windows o Mac, lo que no está nada mal por ese precio. Aparte de eso, cada usuario obtiene 20GB de espacio en la nube de Microsoft por medio de OneDrive (lo que antes de llamaba SkyDrive), lo que será mucho más que suficiente para almacenar todos los documentos de Office que el usuario promedio vaya a utilizar. Habiendo hecho esas aclaraciones, la gran pregunta que muchos se harán es ¿Por qué lanzó Microsoft a Office a una plataforma que compite contra sus propias tabletas, y por qué para el iPad y no para Android? Pues he aquí mis opiniones... Leer el resto de este artículo... autor: josé elías |

|

|

|

|

|

lunes, marzo 24, 2014

|

¿Recuerdan la noticia acá mismo en eliax de que Facebook había iniciado toda una nueva división dentro de su empresa encargada a la investigación en Inteligencia Artificial? Pues acá tienen uno de los primeros frutos... ¿Recuerdan la noticia acá mismo en eliax de que Facebook había iniciado toda una nueva división dentro de su empresa encargada a la investigación en Inteligencia Artificial? Pues acá tienen uno de los primeros frutos...Según Facebook, la empresa ha desarrollado un sistema de reconocimiento de caras humanas al que ha apodado DeepFace ("Cara Profunda"), la cual funciona ya a niveles que podríamos decir "humanos" a la hora de reconocer una cara humana entre una multitud, y bajo distintas condiciones (en una foto, en un video, en oscuridad, parcialmente bloqueada, mirando en distintas direcciones, etc). Pero, ¿qué tan preciso es DeepFace? Pues según Facebook, el sistema ya puede reconocer una cara con un 97.25% de exactitud, lo que es muy cerca de lo mejor que podemos hace los mejores humanos en este aspecto. ¿Para qué le sirve esto a Facebook? Pues obviamente para poder reconocernos en fotos y videos que subimos a su red social, de forma totalmente automatizada, de forma que la red de interconexiones sociales que posea la empresa pueda ser aun más precisa. Sin embargo, por otro lado esto también traerá de regreso la preocupación que muchos tenemos en términos de privacidad, en el sentido de que ¿realmente queremos que se nos identifique automáticamente, y sin nuestro consentimiento? Imaginen por ejemplo que alguien famoso está tomando unas vacaciones tranquilas en alguna playa con su familia, y que este de pura casualidad salga en el fondo de una foto que otra familia le tomó a sus propios hijos, y que Facebook automáticamente etiquete esa foto con el nombre de la persona famosa... Eso no sería un buen escenario para la privacidad de esa persona... Y lo mismo podría aplicar a todos nosotros en diversos momentos de nuestras vidas en donde sencillamente deseamos privacidad. Obviamente, las autoridades gubernamentales van a desear poner sus manos en esta tecnología, con el pretexto de que esto será utilizado solo para identificar a criminales, sospechosos, y terroristas, y en teoría esa es una muy buena excusa, pero conociendo nosotros bastante bien lo fácil que es corromper al ser humano, no duden ustedes de que tecnologías como estas nos traerán muchos dolores de cabeza en los años venideros... anuncio oficial de del Facebook DeepFace autor: josé elías |

|

|

|

|

|

miércoles, marzo 19, 2014

|

Por si no lo han notado, estamos estamos en los inicios de una nueva era (por ahora experimental) en computación personal, con lo llamado "Ropa Inteligente", un tema que si son lectores veteranos de eliax ya están familiarizados, ya que llevo unos años explicando el término y anunciando su llegada (leer por ejemplo el punto #10 que hice a finales del 2011). Por si no lo han notado, estamos estamos en los inicios de una nueva era (por ahora experimental) en computación personal, con lo llamado "Ropa Inteligente", un tema que si son lectores veteranos de eliax ya están familiarizados, ya que llevo unos años explicando el término y anunciando su llegada (leer por ejemplo el punto #10 que hice a finales del 2011).El término aun no se ha estandarizado (en inglés por el momento lo que más se utiliza es "Inteligente Wear" o "Smart Wear"), pero lo importante a entender es que se avecina un momento en donde todos los accesorios que tengamos en nuestro cuerpo tendrán algún nivel de inteligencia o interacción. Y es bueno notar que esto no es algo nuevo. Empresas como Pebble con su reloj inteligente ya llevan años en el mercado, y otras como Casio ya vendía relojes de pulsera con calculadoras, radios, y hasta televisores y teléfonos hace al menos 2 décadas atrás, pero apenas hoy día es que la tecnología está avanzando y convergiendo lo suficiente como para hacer este tipo de dispositivos verdaderamente prácticos. A la fecha, los dos grandes dispositivos que hemos visto en el mercado en representación de esta nueva categoría han sido las gafas inteligentes Google Glass, y el reloj inteligente Galaxy Gear de Samsung, pero por el momento no hemos visto un gran éxito de uno de estos dispositivos en el mercado. En el caso del Google Glass, estas gafas por el momento han sido disponibles solo para desarrolladores de software, en cantidades limitadas y con funcionalidades y especificaciones limitadas (y precio sumamente alto, rodando los US$1,500 dólares en su versión inicial), por lo que en realidad es más una plataforma de experimentación por parte de Google para ver qué aplicaciones se inventan los usuarios, y cómo refinar la tecnología para futuras iteraciones. Y en el caso del Samsung Gear (ahora en su segunda versión), Samsung ha restringido demasiado el producto para que requiera y funcione solo con un subconjunto de sus celulares inteligentes, así como ha creado un interfaz de usuario lejos de lo ideal (que solo descubrimos tiempo después de este haberse anunciado y ya haber salido al mercado), por lo que las ventas han sido muy bajas. Ahora sin embargo, Google acaba de tomar el liderazgo en la industria sacando el primer SDK (Software Development Kit, o herramientas de programación estandarizadas) para este tipo de aplicaciones, y lo está mercadeando como el "Android Wear SDK". En esencia, lo que Google está diciendo con este SDK es que quiere que sean los fabricantes de terceros (y no necesariamente Google mismo) quienes deben utilizar su imaginación y visión para crear una nueva generación de dispositivos personales inteligentes, y de paso abrir por completo la plataforma para que cualquier desarrollador de software pueda inventar lo que desee. Inicialmente el SDK está orientado a relojes inteligentes, pero es fácil ver este SDK expandido para cubrir a aplicaciones para gafas inteligentes y otros (por ejemplo, hoy día el SDK permitiría desarrollar aplicaciones para bandas de muñeca que monitoreen tu salud, sin necesidad de pantallas, como lo hace la banda Up de Jawbone). Así que este SDK en mi opinión es un gran paso en esta naciente industria, y uno que era necesario. Esto por ejemplo hará que Samsung mejore sustancialmente el interfaz de sus Galaxy Gear, haciéndolos mucho más competitivos antes de que llegue el rumoreado (y esperado) reloj inteligente iWatch de Apple, para el cual Apple aparenta estar tomándose su tiempo para sacar el producto más pulido posible (como usualmente hace). Y hablando de Apple, no cabe duda que estas movidas de Samsung y Google son movidas preventivas para bajar un poco el impacto el iWatch, pues estas empresas obviamente no quieren ser tomadas una vez por sorpresa como sucedió con el original iPhone, y posteriormente con el iPad. De paso, creo que Google tiene una ventaja que podría crear un digno rival al iWatch, y es su excelente servicio Google Now (su servicio que responde a nuestros comandos de voz). Google Now para mi es superior a Siri en todo lo que no sea funcionalidad local al dispositivo (es decir, en preguntarle y pedirle cosas genéricas, en vez de simplemente crear entradas en tu agenda o marcar números telefónicos), y eso significa que Apple tendrá que mejorar sustancialmente a Siri para poder hacer frente en esta nueva generación de dispositivos... En cuanto a la implementación actual de Android Wear, Google ha hecho un trabajo inteligente, permitiendo una transición extremadamente gradual al Wear SDK, permitiendo que el 95% de lo que los programadores de Android ya conocen se traslade directamente a Wear, esto incluyendo el lenguaje de programación, las librerías principales de utilidades, y los interfaces de programación. Así que aplausos a Google, ahora solo falta ver qué es lo que nos tiene Apple bajo la manga, y por otro lado sería interesante también ver si Amazon planea en un futuro entrar a este espacio. Y en nota relacionada, es una lástima no ver a Microsoft por ningún lado en el mapa en este espacio, llegando posiblemente tarde, una vez más, a otra de esas grandes olas de tendencias en el espacio de consumidores... En cuanto a las empresas que planean soportar el Wear SDK próximamente, se encuentran Asus, HTC, LG, Motorola, Samsung, MIPS, Broadcom, Imagination, Intel, Mediatek, Qualcomm, y Fossil Group (la misma empresa de los populares relojes de pulsera tradicionales Fossil). No dejen de ver el cuarto video a continuación que muestra lo que Motorola planea sacar al mercado (bajo el nombre de "Moto 360"), lo que les dará una idea hacia donde va todo este tema. El Moto 360 (y posiblemente otros dispositivos de empresas como LG) los veremos posiblemente a mediados de este año 2014 en curso, y a más a tardar ciertamente antes de finalizar el año. anuncio oficial del Android Wear SDK por Google página oficial del Android Wear SDK para desarrolladores de software Un video para consumidores de Android Wear a continuación (enlace YouTube)... Video que explica el Android Wear a continuación (enlace YouTube)... Video para desarrolladores de Android Wear a continuación (enlace YouTube)... Video del Moto 360 a continuación (enlace YouTube)... autor: josé elías |

|

|

|

|

|

jueves, marzo 6, 2014

|

En los días posteriores al anuncio de CarPlay de Apple (esencialmente, la fusión del iPhone con los automóviles), me ha sorprendido que incluso grandes portales de noticias tecnológicas han caído en la trampa de reportar que la tecnología que habilita a CarPlay the Apple es QNX de Blackberry. En los días posteriores al anuncio de CarPlay de Apple (esencialmente, la fusión del iPhone con los automóviles), me ha sorprendido que incluso grandes portales de noticias tecnológicas han caído en la trampa de reportar que la tecnología que habilita a CarPlay the Apple es QNX de Blackberry.Los ingenieros de Apple, y los de Blackberry, deben estar muriéndose de la risa con esa afirmación, la cual hacen unos cuantos que no tienen la menor idea de los detalles técnicos de estas implementaciones. Así que para que paren los rumores y noticias falsas (y las decenas de enlaces de lectores del blog diciéndome que me informe mejor ya que "CarPlay es un producto que existe gracias a Blackberry"), les explico qué es lo que sucede... QNX, para el que no sepa, es lo que se llama un sistema operativo "de tiempo real", utilizado no solo en sistemas de "infoentretenimiento" en automóviles, sino además en sistemas incrustados en todo tipo de dispositivos, electrodomésticos, sistemas de defensa, e incluso sondas espaciales. Es un sistema operativo extremadamente robusto, y muy respetado entre ingenieros de cualquier empresa que sepa al menos un poco del tema de este tipo de sistemas operativos. Pues bien, alrededor del 2010 RIM (el antiguo nombre de la empresa que hoy todos conocemos como Blackberry) compró a QNX, para utilizar como la base de sus futuros celulares inteligentes. Pero eso no significa que Blackberry en la actualidad haya detenido el negocio tradicional de QNX, como en lo que nos compete con el tema de hoy, que es el de licenciar a terceros a QNX para que lo utilicen como un sistema operativo de automóviles, en donde es bastante popular. ¿Y dónde entre Apple y toda la confusión al respecto? Pues al hecho de que CarPlay no es un producto, sino una especificación técnica. Cualquier fabricante de equipos de entretenimiento para automóviles, puede firmar un contrato con Apple, e implementar los protocolos, interfaces y especificaciones de CarPlay en su sistema de entretenimiento actual, sin importar si ese sistema está basado en QNX, Linux, Android, u otros sistemas abiertos o propietarios. CarPlay no tiene nada que ver con QNX de la misma forma que Facebook en un iPhone no tiene nada que ver con Apple ni iOS, sino que es simplemente un servicio instalado encima de este. Así que por ejemplo, si Volvo ya tiene su propio sistema de entretenimiento corriendo sobre QNX, los ingenieros de Volvo pueden implementar los protocolos de CarPlay en su entorno de desarrollo para la plataforma de entretenimiento de Volvo, el cual simplemente sucede en este caso en específico que es QNX. O en otras palabras, CarPlay no es el radio mismo dentro de tu auto, sino el protocolo que permite que ese radio se comunique con tu iPhone. Así que deciri que "la tecnología que permite que CarPlay exista es QNX de Blackberry" es como decir "la tecnología que permite que el Internet exista es un celular Nokia con el navegador web Opera", lo cual no tiene ningún sentido, ya que el Internet no depende de ni de Nokia ni de Opera, así como CarPlay no depende en lo absoluto ni de Blackberry ni de QNX. Incluso, que no les sorprenda si en el futuro vemos sistemas de entretenimiento para automóviles corriendo encima de una distribución especial de Android o Linux, pero que es compatible o incluso diseñado para funcionar exclusivamente con CarPlay. Así que espero eso aclare un poco las dudas... autor: josé elías |

|

|

|

|

|

viernes, febrero 7, 2014

|

Ya faltando apenas 3 artículos más para finalizar mis 10,000 artículos consecutivos publicados diariamente en eliax, esta noticia de hoy creo que viene bastante bien apropiada, ya que uno de los temas recurrentes de eliax durante ya casi 9 años siempre ha sido el de La Singularidad, un evento del cual he venido evangelizando incluso mucho antes de eliax, como por ejemplo en mi libro del 2001 Máquinas en el Paraíso. Ya faltando apenas 3 artículos más para finalizar mis 10,000 artículos consecutivos publicados diariamente en eliax, esta noticia de hoy creo que viene bastante bien apropiada, ya que uno de los temas recurrentes de eliax durante ya casi 9 años siempre ha sido el de La Singularidad, un evento del cual he venido evangelizando incluso mucho antes de eliax, como por ejemplo en mi libro del 2001 Máquinas en el Paraíso.Y la gran noticia de hoy es que Ray Kurzweil, la persona que más ha popularizado el concepto de La Singularidad Tecnológica, y quien Google recientemente contrató para ser su Director de Ingeniería y encargado de todo lo que tenga que ver con Inteligencia Artificial dentro de la empresa, acaba de declarar en una entrevista del Wall Street Journal, que ya para el 2035 poseeremos tecnología que permitirá que los seres humanos conectemos directamente nuestros cerebros a la nube de Internet. Eso, sonaría un poco sensacionalista viniendo de cualquier otra persona, pero Kurzweil tiene una espectacular carrera como visionario y futurista, prediciendo muchas cosas que hoy damos por sentado, como sintetizadores de voz, dispositivos en nuestras manos con más poder que supercomputadoras de hace pocas décadas atrás, el crecimiento de redes como el Internet, etc. Yo personalmente creo (en base a toda la evidencia que apoya este tipo de investigaciones), que no es cuestión de si esto será posible o no, sino más bien de cuando. Muchos dirán, "bien, digamos que sí es posible, me lo creo, pero lo que no creo es que veremos esto hecho realidad dentro de poco más de un par de décadas, esto lo veo más posible dentro de 100, 200, o incluso mil años", pero pensar así es erróneo por una sencilla pero potentísima razón: La ciencia y la tecnología evolucionan exponencialmente, no linealmente. Para los que no entiendan ese concepto, ponderen este ejemplo... Digamos que toman un celular cualquiera, y que yo les diga que lo acuesten en una mesa, y que midan cuanto mide. Y después yo les pida que dupliquen la distancia de ese celular colocando otro celular al lado de ese (en su lado largo), de modo que ahora medimos el doble de antes. Y digamos que yo les pida ahora que coloquen 2 celulares más, uno al lado de otro, de modo que ahora la distancia se duplica otra vez (con 4 celulares), y que repitan ese proceso muchísimas veces, duplicando la distancia cada vez, con 8, 16, 32 celulares, etc. Ahora viene la pregunta: ¿Cuántos veces tendrían que duplicar la distancia de los celulares, para tener tantos celulares como para llegar de la Tierra al Sol? Y les recuerdo que la distancia de la Tierra al Sol es aproximadamente de unos 150 millones de kilómetros... La respuesta posiblemente les sorprenda, pues es solo 45. Por increíble que parezca, si repiten el mismo proceso de duplicar el largo de un celular durante 45 veces, no solo habrán creado una distancia que llega al Sol, sino que la sobrepasa por mucho... Eso es una progresión geométrica, o una progresión exponencial, o un crecimiento exponencial. Al otro extremo tendríamos una progresión o crecimiento lineal. En este modelo, lo que haríamos es colocar un celular sobre la mesa, e ir agregando un solo celular a la vez, hasta que lleguemos al Sol, y la pregunta es, ¿cuántos celulares necesitaríamos? La respuesta es que necesitaríamos más de 10,000,000,000,000 celulares (10 millones de millones de celulares). O en otras palabras, linealmente necesitaríamos 10 billones de la distancia que mide un celular para llegar hasta el Sol, mientras que exponencialmente solo necesitaríamos duplicar 45 veces la distancia que mide un celular. Y no se si lo han notado, pero existe una descomunalmente grande diferencia entre 10 billones de unidades, y 45 unidades... Pues similarmente, algo que ha sido comprobado, medido, observado, y vivido por nosotros durante toda nuestra existencia en el planeta, es el sencillo hecho de que todo evoluciona exponencialmente. En la práctica eso significa lo siguiente: Si hace 45 años atrás tuviésemos una supercomputadora que calculaba a 10 trillones de unidades (de lo que fuera) por segundo, mientras que un hipotético celular calculaba solo 1 unidad por segundo, y alguien te preguntaba en cuánto tiempo en el futuro tendríamos un celular con el poder de esa máquina, la respuesta lineal (e incorrecta) sería decir que si asumimos que cada año un celular que antes ejecutaba una unidad de trabajo ahora puede ejecutar otra mas, que entonces tardaríamos 10 trillones de años en que un celular tuviese la capacidad de esa supercomputadora. Sin embargo, en la práctica sabemos que el poder computacional crece exponencialmente, y sin en nuestro caso hipotético asumimos que el poder del celular se duplica cada año, que entonces en vez de 10 trillones de años, tardaríamos apenas 45 años en tener un celular con el poder de esa supercomputadora. Esto podrá sonar increíble o imposible, ¿pero adivinen que? eso es precisamente lo que ha estado ocurriendo, y es la razón por la cual hoy día un celular de gama alta cualquiera tiene más poder computacional que todas las supercomputadoras sobre la faz de la Tierra combinadas hace apenas pocas décadas atrás. Esa es la razón también por la cual si le hubieses dicho a alguien hace 100 años que dentro de 100 años en un futuro tendríamos televisores que enviarían imágenes en tiempo real al otro lado del mundo, teléfonos para hablar bi-direccionalmente de cualquier punto de la Tierra a otro, una red mundial que conecta miles de millones de personas y que permite enviar mensajes en menos de un segundo de cualquier punto a otro, o máquinas que pueden ver en tiempo real dentro de nuestro cuerpo, o telescopios que nos permitirían ver casi el origen mismo del universo, o microscopios que nos permitirían ver muchísimo más adentro de los átomos mismos, o hornos de microondas para calentar comida en segundos, o aires acondicionados para enfriar nuestros hogares, o robots que caminarían como nosotros (y hasta nos ganarían en juegos intelectuales), o naves espaciales que explorarían los confines del Sistema Solar, o las miles de otras maravillas que hoy tomamos por sentado y dado, es casi seguro que te llamarían una persona total y irrefutablemente "loca". Y los que no dijeran que eres una persona totalmente loca, y que incluso te dieran la razón de la duda de que "algún día" esas cosas de las que le hablas serían posible, es muy probable que te hubiesen dicho "eso será posible dentro de miles y miles de años"... Y ese es el punto a entender sobre esta noticia y las miles de las cuales les he hablado a través de los años en eliax. Muchas de estas maravillas de las cuales les he hablado en el blog, y que vemos en el horizonte, llagarán mucho antes de lo que se imaginan. Solo piensen en esto: Hace apenas 10 años, la mayoría de nosotros no utilizábamos celulares. 10 años. Hoy un celular es parte íntegra de nuestros cuerpos. Hace apenas 10 años Facebook era apenas un portal más que aspiraba "algún día" a tener 1 millón de usuarios. Hoy tiene mucho más de mil millones de personas conectadas. Así que cuando lean este tipo de noticias, es importantísimo dejar a un lado el instinto lineal bajo el cual evolucionaron nuestros cerebros, e iniciar a pensar en términos exponenciales, pues de no ser así el futuro no solo les llegará más rápido de lo que se imaginan, sino que los dejará atrás más rápido de lo que se imaginan... Y volviendo a la noticia de hoy, lo que Kurzweil de Google está diciendo es que para el 2035 (súmenle o quítenle unos cuantos años, pero de que sucederá, sucederá), poseeremos tecnología que conectaremos a nuestros cerebros, posiblemente en forma de nanobots (robots ultra-miniaturizados) y que de forma inalámbrica nos conectarán a todos al Internet, y por ende a cada uno de los otros seres humanos del planeta, y al poder computacional que podamos poner en la nube. Eso significa el poder tener acceso a un nivel de computación tal, que cualquier persona dentro de unas décadas poseerá más poder computacional que todos los seres vivos y máquinas de hoy día combinados, y eso tendrá repercusiones que van muchísimo más allá de lo que la mayoría de seres humanos de hoy día se imaginan. Bienvenidos a La Singularidad... autor: josé elías |

|

|

|

|

|

jueves, enero 16, 2014

|

Mis amig@s lectores, hoy es un triste día para consumidores, y considero muy importante que estén al tanto de esta noticia... Mis amig@s lectores, hoy es un triste día para consumidores, y considero muy importante que estén al tanto de esta noticia...Sucede que la Corte de Apelaciones para el Distrito de Columbia en los EEUU acaba de anular el concepto de la Neutralidad de Red entre los ISP (Internet Service Providers). Primero un poco de terminología básica: Un ISP no es más que la empresa que te dota de Internet, que en muchos casos es también tu empresa de telefonía fija o móvil, y/o de televisión por cable. En cuanto al concepto de Neutralidad en la Red, este es un concepto del cual llevo 8 años hablándoles en eliax, y trata del hecho de que los ISPs deberían tratar con la misma prioridad todo el tráfico de Internet que pase por sus redes, o al menos, no deberían degradar o bloquear deliberadamente el tipo de tráfico que ellos deseen. Pero, ¿qué significa esto? Pues que ahora los consumidores más que nunca estarán atados a los deseos y monopolios de servicios de sus ISPs, y en esto quienes más van a sufrir son todas esas empresas que ofrezcan servicios que compitan contra los de los ISPs. El ejemplo más claro que viene a la mente es Netflix, y por extensión películas de iTunes y de Amazon Video, así como de otros como Hulu, Vudu, YouTube, etc. Y les explico como a continuación... Supongamos que tu ISP te provee no solo de Internet. sino que también de TV por cable. Estos ISPs tienen acuerdos muy lucrativos con grupos que manejan no solo los canales tradicionales, sino principalmente con los canales premium de cable como son HBO, ESPN, Univision, TNT, FOX, Discovery, etc. Los conglomerados que manejan estos canales tiene ya cerca de dos décadas peleando con todas sus fuerzas para tratar de retrasar lo inevitable: Eventualmente, nadie querrá subscribirse a todo un paquete de TV por cable solo para de entre los 200 canales que ofrecen, ver 2 o 3 regularmente como mucho. Así mismo tampoco querrán subscribirse al concepto de un canal de 24 con 20 a 50 programas semanales cuando a ti realmente solo te interesan ver 1 o 2 programas de ese canal. O en otras palabras, estamos en el umbral de "TV a la carta" en donde empresas como Netflix, Apple, Amazon y Google/YouTube nos están permitiendo ver solo aquellos programas que deseamos, y pagar solo por aquellos que deseamos. Esto obviamente pone de cabeza el lucrativo modelo tradicional, abriendo camino a estas nuevas empresas y ofreciendo opciones a los consumidores que no tenían antes. Pero con la nueva medida en los EEUU (que esperemos no dure mucho y que no se esparza por todo el mundo) eso significa que si un ISP ve que sus subscriptores están utilizando mucho a Netflix o iTunes, estos podrán no solo degradar la velocidad ("ancho de banda") de estos servicios para que el video se vea de muy mala calidad (o tengas que esperas varias horas o días para que se descargue el video), o incluso para bloquear el servicio por completo. Con esto los ISPs aseguran sus contratos con los monopolios tradicionales que ofrecen contenido para TV, así como obtienen ahora una licencia gratis para chantajear a Netflix, Apple, Amazon y Google, quienes ahora tendrían que pagarle a los ISPs (quienes pasarían ese costo a nosotros los consumidores) para seguir ofertando sus servicios. Obviamente los ISPs le han dicho a la corte que ellos son buenos corderos y que no planean hacer tal cosa, pero esas afirmaciones no tienen peso legal ya que el solo decirlas no es un contrato social con el estado. Lo que estos ISPs tienen ahora es el poder legal de remover todo rastro de Neutralidad en la Red, y no duden que no tardarán mucho en utilizarlo... Y ojo, que esto fue solo un ejemplo que les dí en el sector de video por Internet. Nada podrá detener a estos ISPs ahora de que chantajeen también a redes sociales como Facebook y Twitter, o sistemas de mensajería como Whatsapp, iMessage o Google Hangouts, o incluso ecosistemas enteros como el App Store de Apple, la tienda Google Play, o el Amazon App Store. Así que ya se pueden imaginar la titánica batalla que se nos avecina en el terreno legislativo debido a estas medidas... documento oficial del gobierno de los EEUU sobre esta decisión (formato PDF) autor: josé elías |

|

|

|

|

|

domingo, diciembre 29, 2013

|

Uno de los usos más importantes que se planea darle a los llamados "nanobots" (robots que se miden en la millonésima parte de un metro, y que por tanto podrán vivir en nuestros cuerpos), es en auxiliarnos en temas de salud (como estos de los cuales que ya les hablé en eliax), pudiendo estos funcionar como linea de defensa proactiva (como un sistema inmunológico complementario y sintético), o hasta para entregar medicinas a diversas partes del cuerpo, o incluso asistir a cirujanos en operaciones de todo tipo. Uno de los usos más importantes que se planea darle a los llamados "nanobots" (robots que se miden en la millonésima parte de un metro, y que por tanto podrán vivir en nuestros cuerpos), es en auxiliarnos en temas de salud (como estos de los cuales que ya les hablé en eliax), pudiendo estos funcionar como linea de defensa proactiva (como un sistema inmunológico complementario y sintético), o hasta para entregar medicinas a diversas partes del cuerpo, o incluso asistir a cirujanos en operaciones de todo tipo.Sin embargo, estos nanobots dependen de circuitos digitales (en esencia, microchips como cerebros) para llevar a cabo sus funciones, cosa que conlleva otros niveles de complejidad en temas de control y abastecimiento energético. Pero, ¿qué tal si hubiese otra forma? Pues eso es precisamente lo que han pensado unos científicos de la universidad de Harvard, quienes acaban de inventar una técnica que les permite codificar algoritmos de Inteligencia Artificial (IA) no en operaciones digitales, sino que en reacciones químicas... O en otras palabras, en vez de tener un mini-robot con un cerebro digital compuesto de transistores ultra-miniaturizados, ¿qué tal si creamos moléculas que al combinarse unas con otras producen el mismo resultado que un cerebro digital pero por medio de la reacción química entre estas moléculas? Esto tiene implicaciones tremendamente grandes, ya que por ejemplo podríamos crear "pastillas inteligentes" que al disolverse podrían dejar ingresar en nuestro organismo una conjunto de moléculas inteligentes que podrían tomar decisiones por sí mismas sobre cómo proceder en el organismo. Así que por ejemplo a un paciente podríamos inyectarle una sustancia llena de estas moléculas para tratar el cáncer, y estas moléculas podrían saber en base a IA cuáles células son cancerígenas y cuáles no, para así solo atacar a las que deben ser destruidas. O incluso, esto podría dar origen a una sub-inteligencia dentro de nosotros mismos que estaría encargada de nuestro bienestar y de gestionar la salubridad total de nuestro medio ambiente, incluso quizás conectándose a nuestros cerebros por medio de interfaces neuronales para no solo recibir órdenes de nuestra mente, sino para además enviar el estado de bienestar o malestar a nuestra consciencia o subconsciencia. Incluso (en un futuro más lejano) no sería descabellado pensar en un futuro en donde podríamos hacer que esta inteligencia molecular sea tan inteligente, y esté tan bien conectada con nosotros y nuestro mundo exterior, que incluso funcione como nuestro Asistente Virtual (como este acá mismo en eliax), ayudándonos con las cosas mundanas de la vida (como reservar aviones, recordándonos reuniones, llamando un taxi, alertándonos de cambios en nuestros negocios, o recordándonos de personas que en ese momento estamos viendo). Y no piensen que esto es ciencia ficción, pues ya empezamos a dar los primeros pasos al respecto con las tecnologías necesarias para llevar todo esto a cabo... fuente oficial en Harvard documento científico oficial autor: josé elías |

|

|

|

|

|

domingo, diciembre 22, 2013

|

|

Como los lectores veteranos de eliax ya saben, uno de los principales temas de este blog es el de La Singularidad Tecnológica, y por tanto es con gran emoción que les muestro hoy este primer avance/trailer de la película Transcendence ("Transcendiente") con Johnny Depp, Kate Mara y Morgan Freeman...

La película se trata de un inminente científico quien al inicio de la película casi pierde la vida, por lo que para salvarlo deciden adelantar un experimento pendiente: Subir su mente a una computadora. Pero al hacerlo, su mente empieza a pedir recursos a escalas inimaginables y ahí empieza nuestra película. La película sale el 18 de Abril del 2014, y pueden estar seguros que me verán en alguna fila/cola de algún cine ese día del estreno... :) Nota: En el 2001 escribí un libro titulado Máquinas en el Paraíso que explica y hasta pronostica muchas de las cosas que verán en esta película. Así mismo recomiendo leer varios de los enlaces que puse al final de este artículo en la sección de "previamente en eliax", y presten particular atención a artículos como este o este otro. ¡Gracias a todos los lectores que me han enviado este video! Video a continuación (enlace YouTube)... autor: josé elías |

|

|

|

|

|

jueves, diciembre 19, 2013

|

|

Hace unos 41 años, Ed Catmull, con su amigo Frd Parke (ambos en ese entonces en la Universidad de UTAH en EEUU), crearon historia al crear la primera película renderizada completamente en 3D.

Hablamos de 1972, cuando todavía computadoras como la IBM PC, Apple II o Commodore 64 no habían sido ni siquiera soñadas, y en donde el término "Computadora Personal" aun no se había inventado, y lo que lograron estos dos es verdaderamente asombroso para la época (aunque noten esta otra noticia acá mismo en eliax, sobre la demostración técnica más asombrosa de todos los tiempos). Como apreciarán en el video, la primera animación que hicieron estos dos fue una versión digital de la mano izquierda de Ed Catmull, quien vale la pena mencionar, eventualmente fundaría PIXAR (que sería propiedad de Steve Jobs, y luego vendida a Disney), y hoy día es el Presidente de Disney, y de Disney Animation Studios. Esto de paso debe darnos una idea de lo asombrosamente rápido que evoluciona la tecnología, pues si a estos dos les hubiesen preguntado que si en el 2013 tendríamos dispositivos que caben en nuestras manos y que renderizarían en tiempo real escenarios casi fotorealistas, no lo hubiesen creído... ¡Gracias al lector Carlos David Correa por el video! Video a continuación (enlace YouTube)... autor: josé elías |

|

|

|

|

|

miércoles, diciembre 18, 2013

|

|

Hoy los dejo con una breve dosis de BREVES en eliax...

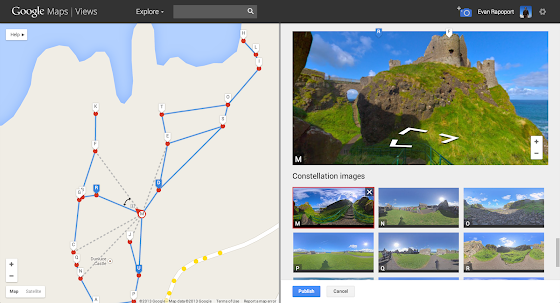

1. Inteligencia Artificial en Facebook  En la inminente guerra de servicios basados en Inteligencia Artificial, Facebook no quiere quedarse atrás ante los esfuerzos de empresas como Google, Apple, Microsoft o IBM, por lo que recientemente contrató a Yann LeCun, un profesor de New York University. En la inminente guerra de servicios basados en Inteligencia Artificial, Facebook no quiere quedarse atrás ante los esfuerzos de empresas como Google, Apple, Microsoft o IBM, por lo que recientemente contrató a Yann LeCun, un profesor de New York University.LeCun será ahora el encargado de todos los esfuerzos de IA por parte de Facebook, lo que significa crear sistemas que aprendan mejor de nuestros hábitos sociales, que puedan predecir nuestros movimientos y deseos (por ejemplo, para vendernos cosas), y en general mejorar la experiencia de Facebook para todos. anuncio oficial por parte de LeCun 2. Google Street View personalizado  Una de las mejores (y menos conocidas) funcionalidades de Google Maps es Google Street View, que es la funcionalidad que te permite "caminar" por las calles, montañas, montes, monumentos, y otros lugares, de forma virtual. Una de las mejores (y menos conocidas) funcionalidades de Google Maps es Google Street View, que es la funcionalidad que te permite "caminar" por las calles, montañas, montes, monumentos, y otros lugares, de forma virtual.Sin embargo, a la fecha, esas "caminatas virtuales" eran posible debido a que Google envía constantemente a todas partes del mundo personas con equipos especializados (tanto en vehículos como a pie) que capturan imágenes de 360 grados en varios puntos de la travesía virtual, lo que como pueden imaginar es un trabajo arduo, y lento... Pero ahora, Google ha decidido permitir utilizar la funcionalidad de Photo Sphere ("Esfera Fotográfica") de recientes versiones de Android para que tú mismo tomes fotos de 360 grados de tus puntos favoritos, y los subas a Google, en donde gracias a las coordenadas GPS de tu móvil, estas imágenes son ensambladas con más imágenes de otras personas para crear una caminata virtual. Así que si tienen un lugar favorito, que podría ser un bar, un museo, monumento, o lugar turístico local que quieras compartir con el resto del mundo, esta es la oportunidad de empezar a aportar... detalles oficiales de parte de Google 3. El estabilizar de video Wiggly para móviles  ¿Recuerdan el asombroso estabilizador de video MōVI del cual les hablé hace un tiempo acá en eliax? Ese dispositivo cuesta unos US$15 Mil dólares, pero ¿qué tal si pudieran tener algo similar por entre US$300 y US$600 dólares (dependiendo de capacidades) para el uso de cámaras móviles? ¿Recuerdan el asombroso estabilizador de video MōVI del cual les hablé hace un tiempo acá en eliax? Ese dispositivo cuesta unos US$15 Mil dólares, pero ¿qué tal si pudieran tener algo similar por entre US$300 y US$600 dólares (dependiendo de capacidades) para el uso de cámaras móviles?Pues eso es precisamente lo que ofrece Wiggly, un proyecto en Kickstarter que espera en las próximas 2 semanas recaudar US$100 mil dólares para fabricar tal dispositivo. Lo mejor es que su creador ya tiene el producto listo (su creador lleva 7 años diseñando este tipo de sistemas), por lo que es solo cuestión de obtener los fondos necesarios para fabricarlos. El Wiggly viene en varias versiones que van desde estabilización en un axis, hasta 2 y 3 (igual que el MōVI). No dejen de ver los videos que acompañan la página del proyecto, el producto se ve verdaderamente bueno, y no solo es para iPhones (como muestran en los videos), sino además para cualquier tipo de cámara pequeña (puedes obtener un adaptador para la GoPro por ejemplo), y me pregunto que tan bien funcionaría esto con la BlackMagic Pocket Cinema Camera... Wiggly en Kickstarter autor: josé elías |

|

|

|

|

|

martes, diciembre 17, 2013

|

Si les preguntaran que estimaran el porcentaje de todo el tráfico de la Web que representa el tráfico de aplicaciones dirigidas por seres humanos, versus el tráfico generado por "bots" (es decir, robots en software que manipulan el Internet), ¿qué cifras dirían? Si les preguntaran que estimaran el porcentaje de todo el tráfico de la Web que representa el tráfico de aplicaciones dirigidas por seres humanos, versus el tráfico generado por "bots" (es decir, robots en software que manipulan el Internet), ¿qué cifras dirían?Pues aunque no lo crean, en el 2013 el 61% de todo el tráfico en la Web fue productos de estos bots. Y si se preguntan ¿qué hacen esos bots? Pues más de lo que se imaginan... Para empezar, gran parte de estos son en realidad herramientas automatizadas para generar contenido SPAM (contenido no deseado, como publicidad para vendernos todo tipo de medicinas u otros productos), mientras que otros son utilizados para fines criminales (como para infectar máquinas y robar datos personales). Así mismo existen unos especializados diseñados para ataques a gran escala (del tipo DDoS), creados por hackers, instituciones y/o gobiernos con el fin de incapacitar a equipos conectados a redes, o incluso violarlos a fuerza bruta para varios fines (desde espionaje hasta guerra cibernética). Mientras que otros son más benignos, como buscadores web (como el de Google, o los de Microsoft y otras empresas más especializadas), y otros se especializan en manipular publicidad y estadísticas de usuarios. En fin, hay para todo uso y propósito, y es asombroso que en esencia ya dos terceras partes de todo el tráficos a páginas web provenga de estos bots automatizados (o manejados remotamente). Y noten que la cifra apenas el año pasado era de un 51%, por lo que hablamos de un incremento de un 21% en apenas 12 meses, lo que nos da una idea de la tendencia... fuente autor: josé elías |

|

|

|

|

|

domingo, diciembre 8, 2013

|

Hoy los dejo con un truco que ya salió hace unos días, pero que por fin lo he probado y me he quedado estupefacto de lo bien que funciona, y se trata de que es posible programar a tu navegador web Chrome para que este inicie su motor de búsqueda sin tu tocar el teclado de tu PC o laptop (por ahora solo para Windows y Mac), y que incluso te responda hablando... Hoy los dejo con un truco que ya salió hace unos días, pero que por fin lo he probado y me he quedado estupefacto de lo bien que funciona, y se trata de que es posible programar a tu navegador web Chrome para que este inicie su motor de búsqueda sin tu tocar el teclado de tu PC o laptop (por ahora solo para Windows y Mac), y que incluso te responda hablando...Para activar esta funcionalidad, simplemente asegúrate de estar utilizando el navegador web Chrome y visita este enlace, y después haz clic sobre el botón verde para instalar la extensión en Chrome. Después que la instales (toma solo unos segundos), notarás que cuando abres una nueva pestaña en blanco en Chrome, o cuando entres a google.com, que en la barra de buscar dirá en un color gris claro la frase "Say ok google" (si tienes tu sistema en español asumo que dirá algo como "Di okey google"), lo que te indica que la extensión está instalada. Así que ahora para probarlo, ni siquiera toques el teclado y simplemente di la frase "okey google", y verás como mágicamente el buscador se activa y espera que le des nuevas instrucciones de voz para buscar (obviamente, tu PC o laptop debe tener un micrófono, este debe estar activo, y los parlantes/bocinas deben estar activas y con el volumen que tu puedas escuchar). Noten que en muchos casos el buscador te responde también con una voz sintética, particularmente cuando le preguntas cosas que puede contestar directamente, como por ejemplo la temperatura en alguna ciudad del mundo (prueben "okey google, el clima en buenos aires" o "ok google, the weather in new york"). Noten que esta es la misma funcionalidad que Google está implementando en sus celulares Moto X y Nexus 5, pero ahora en el mundo de la PC. Y a propósito, esto me recordó bastante la computadora de La Federación en Star Trek: The Next Generation que funciona de forma bastante similar, solo que en vez de decir "ok google" en la serie de TV simplemente dicen "computer". Finalmente, podemos decir que este es un paso más a este escenario del cual les hablé hace unos años acá mismo en eliax... autor: josé elías |

|

|

|

|

|

miércoles, noviembre 27, 2013

|

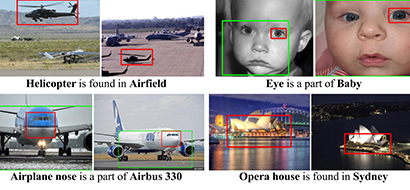

La Universidad de Carnegie Mellon en los EEUU acaba de dar un gran paso en el campo de la Inteligencia Artificial (IA) al haber desarrollado un sistema al que llama el Never Ending Image Learner (NEIL, que en español sería algo como el "Aprendiz Interminable de Imágenes"), que según sus investigadores ha aprendido por sí mismo el concepto del "sentido común", cuando menos en lo que a reconocer imágenes se refiere por ahora... La Universidad de Carnegie Mellon en los EEUU acaba de dar un gran paso en el campo de la Inteligencia Artificial (IA) al haber desarrollado un sistema al que llama el Never Ending Image Learner (NEIL, que en español sería algo como el "Aprendiz Interminable de Imágenes"), que según sus investigadores ha aprendido por sí mismo el concepto del "sentido común", cuando menos en lo que a reconocer imágenes se refiere por ahora...Lo que NEIL ha logrado aprender por sí solo es el entender las conexiones que hacemos los humanos para asociar distintos tipos de imágenes diferentes dentro de un mismo grupo, en esencia buscando el sentido común que varias imágenes comparten. NEIL es un sistema de IA con 200 núcleos que funciona 24 horas al día, los 365 días del año, y lo único que hace es navegar el Internet por su cuenta, buscar imágenes, y tratar de hacer todo tipo de conexiones entre ellas. Entre las cosas que NEIL ha aprendido por su cuenta (y que son cosas que los humanos clasificamos como "sentido común") están que los edificios son por lo general altos, o que los patos son animales parecidos a los gansos. Pero tan asombroso como eso, es que uno puede visitar la página web del proyecto NEIL, y ver en tiempo real las últimas cosas que NEIL está aprendiendo por su cuenta, y debo decirles que es verdaderamente asombroso lo que he visto en esa página, ya que aunque son cosas que incluso para un niño son "obvias", no son cosas que uno esperaría de "una máquina". Me refiero a que literalmente está aprendiendo el concepto del sentido común en las cosas, y más asombroso aun, que ha expandido su dominio de las cosas a temas que no son estrictamente visuales (aunque sí las aprendió visualmente), como el hecho de haber aprendido por sí sola que los autos tienen ruedas (una vez más, algo obvio para nosotros, pero que nadie le enseño previamente a NEIL). Noten que aparte de ver lo que NEIL está aprendiendo en determinado momento, que puedan además entrenar a NEIL en cosas nuevas si lo desean, así como ver "el interior de su mente", que los desarrolladores de NEIL llaman "escenas", viendo ustedes las asociaciones que NEIL ha hecho previamente para descubrir nuevos conceptos. Noten que esta noticia se las traigo apenas días después de hablarles de la IA de Google acá mismo en eliax, testamento a lo rápido que estamos avanzando en el área de la Inteligencia Artificial en estos días... página oficial de NEIL nota de prensa oficial autor: josé elías |

|

|

|

|

"Por mas de que hallan oportunidades y posibilidades en la vida, un pesisimista solo ver[a oscuridad, destrucción y miseria en todos lados."

en camino a la singularidad...

©2005-2026 josé c. elías

todos los derechos reservados

como compartir los artículos de eliax

Seguir a @eliax