|

miércoles, agosto 20, 2008

|

Científicos del Beth Israel Deaconess Medical Center (BIDMC) en Boston, EEUU, acaban de desarrollar una extraordinaria tecnología que permite que las células cancerosas se puedan ver a plena vista con ayuda de una luz especial. Científicos del Beth Israel Deaconess Medical Center (BIDMC) en Boston, EEUU, acaban de desarrollar una extraordinaria tecnología que permite que las células cancerosas se puedan ver a plena vista con ayuda de una luz especial.La tecnología hace que el tejido canceroso de un paciente resalte de manera bastante llamativa, como si de una pintura fluorescente se tratara, lo que permitirá que por primera vez los cirujanos puedan extirpar tejido canceroso sin estar a ciegas como lo hacen actualmente. Hoy día un cirujano básicamente tiene que utilizar su experiencia para literalmente adivinar cuánto tejido canceroso extirparle a un paciente, lo que conlleva a que tome difíciles decisiones, como son ¿le extirpo poco y me arriesgo a dejarle tejido canceroso, o le extirpo mucho y le quito tejido de mas innecesariamente? Con esta nueva tecnología, llamada FLARE (de "Fluorescence-Assisted Resection and Exploration") eso ya será cosa del pasado, porque como pueden apreciar en la imagen, ahora es totalmente claro cuál es el tejido canceroso y cuál no. Fuente de la noticia autor: josé elías |

|

|

|

|

|

|

Esta noticia es solo un rumor, pero según dicen, tan pronto como la próxima semana NVIDIA anunciará su primer procesador compatible con la arquitectura x86, lo que pondría a la empresa en competencia directa con Intel y AMD en el mercado de microprocesadores. Esta noticia es solo un rumor, pero según dicen, tan pronto como la próxima semana NVIDIA anunciará su primer procesador compatible con la arquitectura x86, lo que pondría a la empresa en competencia directa con Intel y AMD en el mercado de microprocesadores.Esto, aun no sea cierto, en mi opinión tiene mucho sentido de que lo haga NVIDIA. Por un lado AMD compró a ATI y ahora está experimentando con los primeros chips que contendrán un CPU y un GPU (de gráficos) en un solo chip, y por su parte Intel ha dejado claro que competirá fuertemente en el campo de gráficos contra AMD/ATI y NVIDIA en los próximos meses/años. Esto dejaría a NVIDIA vulnerable a que los usuarios compren chips de Intel y AMD que ya tengan chips de gráficos de alto rendimiento integrados, relegando a NVIDIA solo a un nicho del mercado de aficionados a video juegos de alto rendimiento. Además, NVIDIA ha acumulado mucha experiencia en el diseño de CPUs con sus GPUs, los cuales son en realidad versiones avanzadas de CPUs, con decenas de núcleos, pero destinados para fines gráficos mayoritariamente. Esperemos ahora a ver si esto se hace realidad, porque sin duda será una novedad (me imagino que lo que sea que saquen tendrá varios núcleos para diferenciarse, pero eso es solo especulación de mi parte). Fuente del rumor autor: josé elías |

|

|

|

|

|

|

La reconocida linea aérea American Airlines acaba por fin de inaugurar sus primeros vuelos en donde puedes optar por una conexión WiFi durante el vuelo, a un costo de US$12.95 (un precio exorbitante, pero que de seguro muchos como yo pagarán para evitar el aburrimiento que es volar en avión por largos períodos de tiempo). La reconocida linea aérea American Airlines acaba por fin de inaugurar sus primeros vuelos en donde puedes optar por una conexión WiFi durante el vuelo, a un costo de US$12.95 (un precio exorbitante, pero que de seguro muchos como yo pagarán para evitar el aburrimiento que es volar en avión por largos períodos de tiempo).Por ahora el servicio está limitado a la flota de aviones Boeing 767-200 en vuelo entre New York y San Francisco, New York y Los Angeles, y New York and Miami. La próxima empresa en linea para ofrecer WiFi en el aire será Delta, la cual muy pronto sacará el servicio en alrededor de 300 de sus aviones. Fuente de la noticia Previamente en eliax: Qantas, American Airlines y Lufthansa: WiFi en aviones (Agosto 2007) Delta Airlines: Todos los vuelos en EEUU con WiFi desde 2009 (Agosto 2008) autor: josé elías |

|

|

|

|

|

|

Hoy ha sido un día bastante activo para Sony y su departamento de Relaciones Públicas y Mercadeo, anunciando al menos 3 productos importantes en un solo día. Hoy ha sido un día bastante activo para Sony y su departamento de Relaciones Públicas y Mercadeo, anunciando al menos 3 productos importantes en un solo día.Lo primero es una nueva versión del PlayStation 3, que vendrá con un disco duro de 160GB y el juego "Uncharted: Drake's Fortune". Esto estará disponible en Noviembre en US$499 dólares. Noten que la "nueva" versión del PS3 de 80GB ya está a la venta en US$399, pero que esta versión viene sin juegos y sin emulación del PS2. Lo segundo es una nueva versión del Sony PSP. La diferencia de esta versus las anteriores es que esta tiene una pantalla de mejor calidad, y ahora viene con un micrófono integrado para esas aplicaciones de VoIP (telefonía de voz por Internet) así como para juegos que soporten voz. Y lo último y mas interesante es un nuevo teclado inalámbrico similar al que Microsoft provee para el Xbox 360, que se adjunta al control de juego y lo hace bastante útil para aplicaciones que requieren entrar texto (como por ejemplo, chateo). Fuente 1 Fuente 2 Fuente 3 autor: josé elías |

|

|

|

|

|

|

No bien nos enteramos de tecnología que nos permitirá crear imágenes con detalles sin precedentes en tiempo real por Internet, cuando sale ahora NVIDIA y demuestra una tecnología que permite crear gráficos con técnicas de raytracing, en tiempo real y en alta definición, utilizando su última generación de GPU (Graphic Processing Units), en tu PC de escritorio. No bien nos enteramos de tecnología que nos permitirá crear imágenes con detalles sin precedentes en tiempo real por Internet, cuando sale ahora NVIDIA y demuestra una tecnología que permite crear gráficos con técnicas de raytracing, en tiempo real y en alta definición, utilizando su última generación de GPU (Graphic Processing Units), en tu PC de escritorio.Para que tengan una idea de lo que estamos hablando, y por qué esto es sorprendente, les explico brevemente lo que es raytracing, y lo que es scanline rendering. Primero, todos los video-juegos que utilizan gráficos de 3D, sea en una PC, un Nintendo Wii, una Xbox 360, un Sony PSP o PlayStation 3, utilizan la técnica de scanline rendering. Lo que esa técnica hace (a altos rasgos) es determinar la posición de la geometría de los objetos en el espacio, determinar dónde hay fuentes de luces, y determinar los colores, propiedades y texturas de las superficies de tales objetos, y calcular en base a complejos algoritmos como se "debería" ver una determinada superficie tridimensional en pantalla. Es decir, el cálculo para "renderizar" un cubo sobre una superficie plana va mas o menos así: "El ángulo de la cara izquierda del cubo está a 45 grados en relación a la cámara por la cual se ve el video-juego, y como hay una luz del otro lado eso significa que esa cara del cubo debe ser un poco oscura, por tanto, pintemos esa cara del cubo de color azul oscuro." En otras palabras, scanline rendering (o rasterizing), es una técnica de deducción, y aunque puede ofrecer excelentes resultados, no es muy precisa ya que no simula "la realidad". Raytracing, sin embargo, es una técnica mucho mas sencilla y fácil de implementar que scanline rendering, ya que de la manera que funciona es como una "cámara digital inversa". Notemos que una cámara digital lo que hace es captar rayos de luz del mundo exterior, sobre un sensor de dos dimensiones (digamos, de 1920 x 1080 pixeles), asignándole a cada puntito en el sensor un valor que indica el nivel de intensidad (y color) de la luz que calló en ese punto. Al combinar todos los puntos obtenemos una imagen. Raytracing hace lo mismo que una cámara digital, pero al revés. En esta técnica, nosotros creamos una "sensor virtual" cuyas dimensiones sean las mismas que la pantalla en donde pensamos desplegar la imagen tridimensional (digamos, un monitor con resolución de 1920 x 1080 pixeles), y lo que hacemos ahora es que simulamos un rayo de luz, no entrando al sensor, sino que saliendo de este hacia el mundo exterior (que en este caso es un cubo sobre una superficie plana), y "midiendo" el rayo de luz mientras este interactúa con los objetos de la escena, la idea siendo que después de que ese rayo de luz emitido por el sensor virtual haya llegado lo suficientemente lejos, que podremos determinar el valor del punto (o pixel) en el lugar desde donde salió el rayo de luz virtual. Es decir, en vez de recibir luz en un sensor (como en una cámara digital), lo que hacemos es emitir luz "blanca", y en base a donde "rebote" ese haz de luz (digamos que la superficie del cubo es de color azul), determinar cual es el color real de ese punto en el sensor (que en este caso hemos determinado no es blanco, sino azul). Esto tiene como resultado que estamos simulando la realidad "al revés", pero simulándola de todas maneras, por lo que podemos obtener resultados verdaderamente asombrosos y realistas. Esta es la técnica que se utiliza en el cine cuando se necesita el mas alto grado de realidad en la pantalla. Siguiendo el ejemplo anterior, la computación en este caso iría algo así: "Acabo de disparar un haz de luz blanca pura desde el pixel con coordenadas 100,580 de la pantalla y voy a ver hacia donde va. Oh, acabo de chocar contra algo (la pared del cubo), ¿cuáles son las propiedades de este objeto en este lugar? ¿cómo desviaría este haz de luz? ¿cómo afectaría su color? Oh, terminaría siendo un color azul. Ahora desviar el rayo de luz unos 193 grados y con menor intensidad X, ya que la superficie es un poco reflectiva, y repetir el proceso unas vez mas, siguiendo el rayo hasta que rebote 10 veces mas y obtener el color final para este pixel." Ahora, los que aun estén leyendo esta explicación dirán, ¿y por qué no utilizar esta técnica en vez de la otra? Por la sencilla razón que es demasiado demandante en poder de computación, ya que por cada punto del "sensor virtual", hay que disparar un rayo de luz virtual, y seguirlo, mientras este rebota, se modifica, se atenúa, etc por toda la escena, y después hacerlo con todos los otros pixeles virtuales. Para que tengan una idea, con un sensor virtual de 1920 x 1080 (que es "full" alta definición en Blu-ray), hablamos de repetir este proceso 2,073,600 veces, y no solo eso, sino que hay que hacer estos cálculos unas 30 veces mas en un solo segundo para lograr video en movimiento. O aproximadamente 60 millones de rayos de luz por segundo, cada uno sumamente demandante en cálculos matemáticos. Es esta la razón por la cual, hasta ahora, las películas de Hollywood que dependen de muchos efectos especiales con raytracing se ejecutan en miles de máquinas en paralelo, las cuales toman tan solo un cuadro de la película, y lo renderizan en cuestión de minutos o hasta horas (a veces días), y después todos estos cuadros son ensamblados en secuencia para formar la película. Habiendo dicho eso, noten ahora el significado de esta noticia: NVIDIA acaba de demostrar que puede hacer raytracing con video de alta definición, en tiempo real a 30 cuadros por segundo, suficiente para uno renderizar el mundo entero de un video-juego mientras uno lo juega. Por ahora la calidad no será igual que la de Hollywood, pero conforme aumenta el poder de computación la calidad continuará incrementando. Noten que en raytracing, aparte de la calidad del algoritmo que calcula cómo es afectado un pixel virtual conforme la luz interactúa con el medio ambiente virtual, saltando de una superficie a otra como si de espejos se tratara, que la otra gran variable que determina la calidad visual de una escena renderizada con raytracing es precisamente cuántas veces uno permite que un rayo de luz "salte" de un lado a otro en la escena, ya que mientras mas saltos y reflejos da ese haz de luz, con mas exactitud se puede calcular el valor final del pixel virtual. Noten que Intel es un gran proponente de raytracing, y dice que sus futuros diseños de chips serán optimizados para acelerar la renderización tridimensional con esta técnica. Reseña curiosa: Hace unos 15 años atrás, con una computadora Commodore Amiga 500, renderizar una escena medio compleja por medio de raytracing me tomaba hasta un día entero (sí, 24 horas, o hasta mas). Hoy día esa misma escena se renderiza en unos segundos, y con esta tecnología de NVIDIA se renderiza en "tiempo real". ¡Como cambian los tiempos y el poder de computación! Fuente de la foto (tienen mas fotos) con mas información Previamente en eliax: Renderización de gráficos en tiempo real desde el Internet (Agosto 2008) autor: josé elías |

|

|

|

|

|

|

|

El lector "Kir" acaba de compartir con nosotros (en este comentario en eliax) un enlace tan interesante que decidí hacerlo una noticia en eliax (aunque noten que por lo general si tienen una sugerencia de noticia de comunicarse conmigo por este medio).

Lo que verán a continuación es una serie de fotografías del tipo "envolvente" (en donde mueves el ratón para girar 360 grados de izquierda a derecha o viceversa, o unos 270 grados de arriba hacia abajo o viceversa), que muestran el interior del LHC (Large Hadron Collider), la máquina mas asombrosa jamás construida por la humanidad. Noten que si tienen una conexión de Internet lenta que deben tener paciencia, pues las imágenes son de muy alta resolución y deben cargarse dentro del plugin de Flash de tu navegador de Internet. Si se fijan debajo verán unos controles que les permite manipular la imagen interactiva. Entre ellos los mas útiles son los de "zoom" ("+" y "-") que les permite acercarse "dentro" de la foto para ver algo en mas detalle. Noten además que verán un par de flechas abajo de la página, una a la izquierda y otra a la derecha; esas flechas les permite ver mas fotos del LHC de este tipo envolvente. Enlace a la página Anteriormente en eliax: El LHC, ¿la creación más sublime jamás realizada por la humanidad? (Mayo 2006) Increíbles fotos del LHC, la máquina mas asombrosa de la humanidad (Agosto 2008) El LHC a inaugurarse el 10 de Septiembre (Agosto 2008) autor: josé elías |

|

|

|

|

|

|

Según una presentación obtenida de manera no autorizada de Intel, la empresa planea lanzar en el 2010 una linea de nuevos procesadores que contendrán por defecto 8 núcleos. Noten que hoy día los procesadores de "8" núcleos de Intel que se venden a usuarios empresariales son en realidad dos chips de 4 núcleos en un solo paquete. Aquí hablamos de 8 "de verdad". Según una presentación obtenida de manera no autorizada de Intel, la empresa planea lanzar en el 2010 una linea de nuevos procesadores que contendrán por defecto 8 núcleos. Noten que hoy día los procesadores de "8" núcleos de Intel que se venden a usuarios empresariales son en realidad dos chips de 4 núcleos en un solo paquete. Aquí hablamos de 8 "de verdad".Además, veremos con esos nuevos chips el estreno de AVX, o "Advanced Vector Extensions", unas extensiones que por el nombre podemos deducir fácilmente que permitirán que estos chips vuelen cuando hagan procesamiento vectorial, como el del tipo que se hace en decodificación y codificación de video de alta definición, o en algo como folding@home, o en simulación de partículas y líquidos en video-juegos. En otras palabras, la próxima generación de chips de Intel ofrecerán instrucciones muy similares a las que hace el chip CELL del PlayStation 3. Estos chips además se fabricarán en un nuevo proceso de 32nm, y soportarán HyperThreading, lo que significa que cada núcleo podrá ejecutar un doble flujo de instrucciones a la vez, por lo que este chip de 8 núcleos en realidad será equivalente a "casi" 16 núcleos. Eventualmente, para el 2012, Intel estima haberse ya movido a procesos de 22nm, lo que multiplicaría aun mas su poder, disminuiría su consumo, y bajaría su costo de producción. Fuente de la noticia Anteriormente en eliax: Intel: 6 núcleos por chip a fin de año, 8 poco después (Marzo 2008) autor: josé elías |

|

|

|

|

|

|

La empresa Advanced Cell Technologies acaba de dar un gran paso en la ciencia de la salud al poder crear por primera vez todo tipo de sangre partiendo de Células Madre. Esto significa que muy pronto será posible crear cantidades ilimitadas de sangre O-negativa (o cualquier otro tipo), para por fin terminar con el problema de no tener sangre compatible cuando se necesite una transfusión. La empresa Advanced Cell Technologies acaba de dar un gran paso en la ciencia de la salud al poder crear por primera vez todo tipo de sangre partiendo de Células Madre. Esto significa que muy pronto será posible crear cantidades ilimitadas de sangre O-negativa (o cualquier otro tipo), para por fin terminar con el problema de no tener sangre compatible cuando se necesite una transfusión.Según los científicos que lograron esta hazaña, esta técnica permite empezar con unas cuantas células, y replicarlas indefinidamente, lo que significa que podemos empezar con un par de células y terminar con un tanque completo del tipo de sangre que uno necesite. Sin duda alguna otro milagro de la ciencia... Fuente de la noticia autor: josé elías |

|

|

|

|

|

martes, agosto 19, 2008

|

Como reportamos anteriormente, Dell está a punto de sacar una laptop en el caliente mercado de las NetBooks de bajo costo (lideradas por la EeePC de ASUS), la cual ya sabemos se llamará la Dell Inspiron 910. Como reportamos anteriormente, Dell está a punto de sacar una laptop en el caliente mercado de las NetBooks de bajo costo (lideradas por la EeePC de ASUS), la cual ya sabemos se llamará la Dell Inspiron 910.La gran sorpresa es que según rumores, vendrá con la última versión de Ubuntu Linux 8.04 instalada por defecto. Otro rumor es un precio base de US$299, pero eso lo sabremos cuando salga, posiblemente en los próximos días o semanas. Así que si quieres ver mas fotos de esta netbook que sin duda será un éxito de ventas para Dell, continúa a este enlace. Otra fuente Anteriormente en eliax: Dell a entrar al mercado de las netbooks con Dell E, Dell E Slim (Junio 2008) autor: josé elías |

|

|

|

|

|

|

Según un nuevo estudio neurológico potencialmente revolucionario, nuestros cerebros están alambrados para que nuestros sentidos puedan tomar el rol de otros en casos extremos, y entre una de las conclusiones está el hecho de que los humanos tenemos la capacidad para literalmente poder "ver" sonidos. Según un nuevo estudio neurológico potencialmente revolucionario, nuestros cerebros están alambrados para que nuestros sentidos puedan tomar el rol de otros en casos extremos, y entre una de las conclusiones está el hecho de que los humanos tenemos la capacidad para literalmente poder "ver" sonidos.La mejor manera de explicar esto es viendo la película Daredevil del 2003 con Ben Affleck, en donde gracias a unos excelentes gráficos de computadoras podemos "ver" cómo es que Daredevil capta el mundo a través de sonidos. Similarmente, según este nuevo estudio, los ciegos estimulan la parte visual del cerebro con los sonidos, e inclusive algunos ciegos legales (asumo del tipo que pueden discernir sombras y luces, pero sin detalles claros) pueden "oír" a través de los ojos. Esto, dicen, es la razón por la cual los ciegos tienen un oído tan agudo, ya que muchas de las funciones del sentido de la vista son ahora "mezclados" con la de los otros sentidos en el cerebro, permitiendo esto que los ciegos de cierta manera "vean" el sonido, cosa que por lo general una persona con vista normal no hace conscientemente. Agregan que esto también explica las reacciones tremendamente rápidas que tienen los animales (incluyendo los humanos) cuando varios de sus sentidos son estimulados a la vez, como cuando un camión se nos acerca de noche y nos alumbra la cara y nos toca su bocina. Esto además explica por qué los sordos tienen por lo general un vista superior a los demás. Fuente de la noticia Crédito de la imagen autor: josé elías |

|

|

|

|

|

|

|

Algunos me han escrito alertándome que no es posible votar con el enlace directo que puse hace unos momentos. Aunque aparenta que votaron, los votos no fueron contabilizados y les sale esto en letra roja "No puede volver a votar hoy!".

Así que si ya trataste de votar anteriormente, te pido de favor que trates una vez mas utilizando las nuevas instrucciones que puse en la noticia actualizada. Muchas gracias! Nota: Si alguien conoce a alguien que trabaje en el Listín Diario, quizás quieran alertarlos de este "bug" en el sistema de votación, que asume que enlaces externos son doble-votaciones, aun provengan de distintas máquinas con diferentes direcciones de IP. autor: josé elías |

|

|

|

|

|

|

Hola a todos, Hola a todos,Actualmente hay un concurso organizado por el periódico Listín Diario para galardonar el "Blog del Año" en tres distintas categorías, y eliax está nominado en la categoría "temática". Si lo deseas, y te gusta el contenido de eliax, te agradecería que votaras. Para votar, es muy sencillo: 1. Visita esta página 2. Haz clic en la solapa que dice "Temáticos". 3. Busca a eliax y haz clic en "Votar" En el paso 3, si quieres encontrar a eliax rápidamente, entra la combinación de teclas Ctrl+F (si tienes tu máquina en Inglés) o Ctrl-B (en español), y en la cajita que sale entra "eliax". ¡¡¡Muchas gracias!!! autor: josé elías |

|

|

|

|

|

|

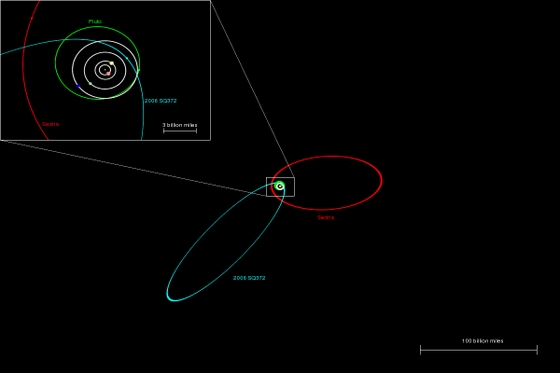

Científicos acaban de descubrir un nuevo "planetoide" en nuestro Sistema Solar, y lo mas asombroso es que este se encuentra aun mas cerca que Neptuno. Científicos acaban de descubrir un nuevo "planetoide" en nuestro Sistema Solar, y lo mas asombroso es que este se encuentra aun mas cerca que Neptuno.El planetoide no es considerado un "planeta" debido a su relativo pequeño tamaño y composición, la cual se cree es simplemente roca y hielo. Por ahora su nombre es "2006 SQ372" (lo que indice que fue visto por primero vez en el 2006), y su órbita alrededor del Sol es de unos increíbles 22,500 años terrestres, llegando en su punto mas lejano a unas 241,000 millones de kilómetros (150,000 millones de millas) de distancia del Sol, o el equivalente a 1,600 veces la distancia entra la Tierra y el Sol. Se estima que el tamaño del objeto es de apenas unas 50-100 km (30-60 millas) de ancho. Es asombroso que aun hoy día estemos descubriendo objetos de esta magnitud en nuestro propio vecindario estelar. Según dicen, el descubrimiento de "2006 SQ372" fue anunciado hoy en Chicago, en el Simposio Internacional sobre el Sloan Digital Sky Survey, y un papel científico formal describiendo la técnica de descubrimiento y las propiedades de este objeto se está preparando para incluirlo en un ejemplar futuro del The Astrophysical Journal. Fuente de la noticia A los astrónomos y aficionados es posible que les interese ver esta animación que muestra varias fotografías del objeto. autor: josé elías |

|

|

|

|

|

|

Palm acaba de anunciar hoy el rumoreado celular inteligente Palm Treo Pro, el cual vendrá con WiFi, GPS, Windows Mobile 6.1, una pantalla de 320x320 pixeles, un procesador de 400MHz, 128MB de memoria (el sistema operativo ocupa otro chip de 256MB), un conector microUSB (como el que utilizan muchas cámaras digitales hoy día), y un conector estándar para audífonos. Palm acaba de anunciar hoy el rumoreado celular inteligente Palm Treo Pro, el cual vendrá con WiFi, GPS, Windows Mobile 6.1, una pantalla de 320x320 pixeles, un procesador de 400MHz, 128MB de memoria (el sistema operativo ocupa otro chip de 256MB), un conector microUSB (como el que utilizan muchas cámaras digitales hoy día), y un conector estándar para audífonos.Aun no sabemos ni el precio ni su fecha de salida al mercado, pero juzgando por lo terminado que aparenta el producto, es prudente decir que "muy pronto" y posiblemente a un bajo precio (subsidiado como los otros Palm Treo). Muy bueno de parte de Palm (me gusta el teclado), pero no lo niego, me sigue gustando el iPhone mucho mas... :) Fuente de la noticia A continuación, una video demostrando al Palm Treo Pro (enlace YouTube)... autor: josé elías |

|

|

|

|

|

|

|

Esto nos imaginábamos iba a ser el caso, después de leer productos anunciados como este. Para los menos técnicos: Esto es equivalente a transferir el contenido de un CD completo en menos de 1 segundo desde el disco duro hasta la memoria de la máquina. En otras palabras, los consumidores comunes y corrientes tendrán en unos meses tecnología que costaba decenas de miles de dólares apenas hace unos meses atrás... Fuente de la noticia autor: josé elías |

|

|

|

|

|

|

|

A continuación los dejamos con un video que los dejará atónitos. Es sobre "Emily", una mujer que verán en el video hablando sobre gráficos por computadora. Lo impresionante del video es que Emily no es una persona real, ni fue basada en una persona real, sino que fue desarrollada y animada completamente en un entorno sintético con las mas avanzadas gráficas "3D" de la industria.

La animación fue creada por Image Metrics, y desde ya está siendo considerada como la primera actuación virtual verdaderamente convincente jamás creada. Noten que hasta ahora la única manera de obtener este grado de realismo era capturando digitalmente las actuaciones de actores reales (como Golum en El Señor de los Anilos, o los personas en Beoworlf), pero esto marca la primera vez que por fin podemos crear actores verdaderamente digitales. Hasta ahora el gran problema era que mientras mas parecido a humanos uno hacía los actores, mas "muertos" aparentaban. Como ejemplo, los personajes de una película como Monsters Inc. aparentan mucho mas "realistas" que los de Final Fantasy The Spirit Within, aun los primeros sean "muñequitos" y los segundos sean "personas". Con este nuevo software ahora se puede emular las pequeñas idiosincrasias y diminutos detalles que nos dan pistas a los humanos de que estamos viendo a una persona. Cosas como pequeños movimientos de músculos, o ver de un lado a otro, o respirar, o la velocidad y ritmo de los movimientos, etc. Así que prepárense, porque combinando esto con tecnología como esta o esta otra, llegará el tiempo en donde será difícil juzgar si un actor es real o sintético. Fuente de la noticia Video a continuación (enlace YouTube)... autor: josé elías |

|

|

|

|

"Gracias Elias por hacernos grandes los pequeños momentos que invertimos en leerte, por todos estos años que has ayudado y enseñado a tantas personas, la labor de este blog tiene mucho mérito... espero que no lo abandones al 100% y que podamos leerte en alguna ocasión.

un abrazo muy fuerte y gracias de corazón."

un abrazo muy fuerte y gracias de corazón."

en camino a la singularidad...

©2005-2024 josé c. elías

todos los derechos reservados

como compartir los artículos de eliax

Seguir a @eliax